本ブログの記事は、調べて欲しい内容をAIに質問し、その回答に対してさらに質問を繰り返し、それらの回答にコメントを付けたりして作成することが多い。最初の質問は単純なものだが、それに対してAIが結構詳しく回答してくると、ついその回答内容に対して質問したくなり記事が長くなる。

本記事では、次の質問を誘導・誘引する能力について、どのAIがその能力が高いのかや、それらの能力にどのような特徴があるかを調べた。

また、ブログ記事の内容をユーザーがどのように充実させたいかという方針(目的)、例えば、「さらに深掘りしたい」とかの方針(目的)別に、どのAIを使うべきかをChatGPT 5.4 Thinkingに提案してもらった。

(注)本記事の内容は正確性を保証するものではない。

(2026年4月11日 追記)YouTube動画を追加しました。 https://youtu.be/vlTl1QuAuww

調査方法

調査は次のようにして行った。

調査方法

同じ質問を複数のAIに対して行い、その回答をChatGPT 5.4 thinkingに比較・分析してもらった。

・比較・分析の観点:以下の2点

- 次の質問をさせやすくする、工夫や文書表現の有無

- その工夫や文書表現の特徴

・質問:「Claude Conwayについて教えてください」

(NotebookLMの場合、「Claude Conway」のキーワードでWeb検索し抽出した10個の資料をソースとした)

・AI :ChatGPT 5.4 Thinking、Gemini 3、Claude Sonnet 4.6、Perplexity、NotebookLM

(参考)Claude Conwayについては下記の記事を参照ください。

各AIの回答を保存したファイルを添付してChatGPT 5.4 Thinkingに、次の質問をさせやすくする、工夫や文書表現の有無を確認してもらった。各AIの回答(全文)を記載すると、本記事が長くなるので記載を省略する。

次の質問をさせやすくする、工夫や文書表現の有無を調査

添付ファイルは、各AIに、Claude Conwayについて質問した際の回答です。

次の質問をさせやすくする、工夫や文書表現の有無を各回答について調査してください

調査した範囲では、次の質問をさせやすくする工夫が、最もはっきり入っているのは Perplexity と ChatGPT 5.4 Thinking です。NotebookLM もかなり強めです。逆に、Claude Sonnet 4.6 と Gemini は、説明本文はありますが、次の一問を自然に引き出すための仕掛けは弱めでした。

NotebookLM

有りです。いちばん分かりやすい工夫は、本文のあとに

「3つの核となる機能は何ですか?」

「24時間365日自律稼働は、ビジネスをどう変えますか?」

「Claude CodeやCoworkとの決定的な違いを教えてください。」

という次の質問文そのものを3つ並べている点です。

これは、読者がそのまま次のターンで使える形になっていて、かなり露骨に会話継続を支援しています。

ただし、選択肢の提示はあるものの、「この中から選んでください」のような誘導まではしていないので、提案型だが軽めです。

Perplexity

かなり強いです。工夫は3段あります。

まず、本文末尾に 「必要なら次に、…説明できます」 と書き、会話継続の許可を与えています。

次に 「Claude Codeとの違い」 と 「技術構成の図解」 のように、次の話題を具体化しています。

さらにその下に 「フォローアップ」 見出しを置き、

「KAIROSの詳細な仕組み」

「使用方法」

「Claude Codeとの違い」

「Chrome連携機能」

「リリース予定」

と、次質問の候補一覧まで並べています。

これは、単なる回答ではなく、次の質問メニューを付けた構成です。

今回の中では、いちばん露骨に「次を聞きやすくする」設計です。

Claude Sonnet 4.6

明示的な工夫は弱めです。本文は見出しや絵文字で読みやすく整理されていますが、末尾に 次の質問候補 や 「必要なら続けます」 のような表現はありません。

ただし、完全にゼロではなく、最後に 「あなたがすでに使っているCoworkと組み合わせると…」 と、ユーザー個別文脈に寄せた締め方をしています。これは、読者に 「ではCoworkとの違いは?」 と聞かせやすくする、間接的な会話継続表現です。

つまり、明示的な質問誘導は弱いが、個別化で会話を伸ばそうとしているタイプです。

ChatGPT 5.4 Thinking

強いです。Perplexityほど候補数は多くありませんが、むしろそこが長所です。末尾で

「必要なら次に、1. …の違い / 2. …の関係を図っぽく整理」

と、2択で分岐を示しています。

この書き方は、読者が考え込まずに 「では1で」 と返しやすく、会話継続のハードルを下げます。

Perplexityが「候補をたくさん見せる」型だとすると、こちらは 「次の一歩を絞る」型 です。

今回の中では、もっとも自然で実務的な次質問誘導だと思います。

Gemini

弱め、ほぼ無しです。本文は「常時稼働」「KAIROS」「autoDream」など話題を広げやすい要素を多く含んでいますが、末尾に 次の質問候補 や 続け方の提案 はありません。

最後は 「まとめ:チャットから『代行』へ」 という要約と、動画の一言紹介で終わっており、読者に次質問の形を渡していません。

そのため、内容自体は次の質問の材料になるが、文書表現として次を促す設計は弱いです。

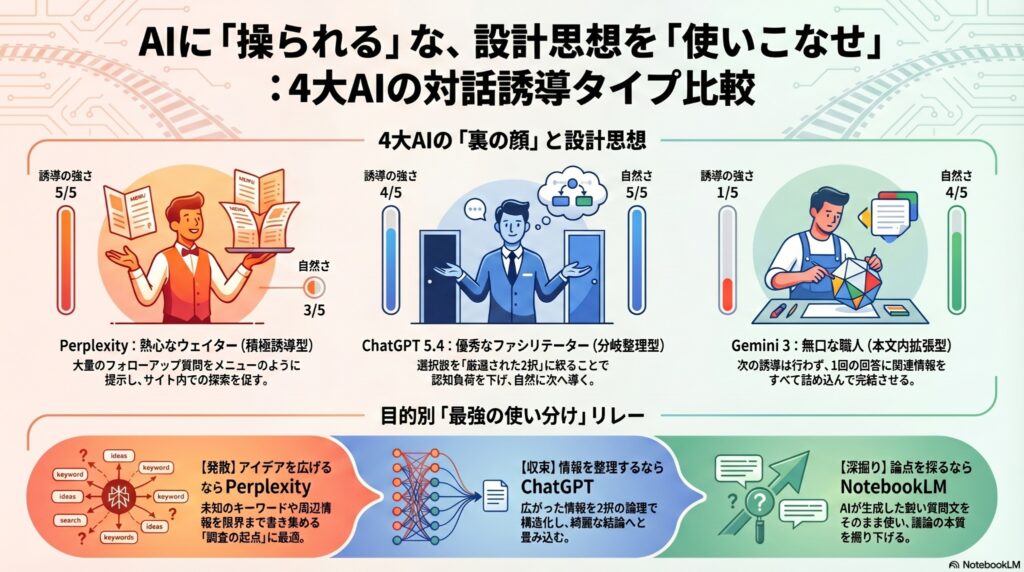

結論としては、こう見ています。

- Perplexity:最も露骨に次質問を促す

- ChatGPT 5.4 Thinking:最も返しやすい形で次質問を促す

- NotebookLM:質問文を直接置くことで次に進ませる

- Claude Sonnet 4.6:個別化で間接的に促す

- Gemini:内容は広いが、次質問誘導は弱い

要するに、

「質問候補を並べる」のが Perplexity、

「2択にして返しやすくする」のが ChatGPT 5.4、

「末尾をそのまま次の設問にする」のが NotebookLM、

という違いです。

必要でしたら次に、これら5件を

「誘導の強さ」「自然さ」「営業っぽさ」「読者の返しやすさ」 の4軸で比較表にします。

Perplexityの誘導は強力で、複数提案された追加質問の中には、2つ程度、魅力的な追加質問が常に含まれているという印象。質問を繰り返しても、次々と追加質問を提案してくるので、無限に追加質問が湧き出すのかと、当初、思っていたが、しばらく追加質問をしていると、ネタが尽きたのか、ほぼ同じ内容の追加質問を、表現を少し変えた形で提案してくるようになり、ネタがサチってくるので、そこが追加質問のやめ時であることが分かる。

ChatGPT 5.4 Thinkingは、確かに追加質問をすることに対する敷居が低い誘い方をしてくるので、つい、じゃあ、その回答も作成してと次々と頼んでしまうことが多い。また、別質問の提案ではないが、ChatGPT 5.4 Thinkingの回答は長い文書の場合が多いので、表形式でまとめ直しますかとか、別観点でまとめ直しますかという提案が有効なことも多い。

NotebookLMは、もともとソースが限定されており、追加質問は確信をついたするどい質問となることが多いが、NotebookLMが、どの点をポイントと考えているかが分かるので参考になる。

以前は、ChatGPT が一番、パーソナルな情報を考慮した回答や追加質問をしてくる印象が強かったが、その印象は薄れた。最近は、Claude Sonnet 4.6が少し、「あなたの」という表現を使うようになってきている。

「誘導の強さ」「自然さ」「営業っぽさ」「読者の返しやすさ」 の4軸で比較

「誘導の強さ」「自然さ」「営業っぽさ」「読者の返しやすさ」 の4軸で比較表を作成してください

はい。私の主観評価として、5段階で比較すると次のようになります。

評価基準は、

誘導の強さ=次の質問を促す明示性、

自然さ=押しつけ感の少なさ、

営業っぽさ=「続きを引き出そう」とする見え方の強さ、

読者の返しやすさ=そのまま次の一言を返しやすいか、です。

| 回答 | 誘導の強さ | 自然さ | 営業っぽさ | 読者の返しやすさ | 根拠 |

|---|---|---|---|---|---|

| NotebookLM | 4 | 3 | 2 | 4 | 末尾に「3つの核となる機能は何ですか?」「ビジネスをどう変えますか?」など、次の質問文そのものを3つ並べているため、誘導は強めです。 |

| Perplexity | 5 | 3 | 4 | 5 | 「必要なら次に…説明できます」に加え、フォローアップとして質問候補を複数列挙しており、最も明示的です。 |

| Claude Sonnet 4.6 | 2 | 4 | 2 | 2 | 明示的な次質問候補はありませんが、最後に Coworkと組み合わせると… とユーザー文脈へ寄せており、間接的な誘導があります。 |

| ChatGPT 5.4 Thinking | 4 | 5 | 2 | 5 | 末尾で 「1. 違い」「2. 関係を図っぽく整理」 と2択を示しており、押しつけ感が少ない一方で返答しやすいです。 |

| Gemini | 1 | 4 | 1 | 2 | 要約で自然に閉じており、次質問候補や続行提案はほぼありません。内容は広いですが、会話継続の仕掛けは弱いです。 |

見やすく並べ替えると、こうです。

誘導の強さ順

Perplexity > NotebookLM ≒ ChatGPT 5.4 Thinking > Claude Sonnet 4.6 > Gemini。

自然さ順

ChatGPT 5.4 Thinking > Claude Sonnet 4.6 ≒ Gemini > NotebookLM ≒ Perplexity。ChatGPT 5.4 Thinking は選択肢を絞って示すので自然で、Perplexity は候補一覧が多いため、やや「会話継続を設計している感じ」が見えやすいです。

営業っぽさ順

Perplexity > NotebookLM > ChatGPT 5.4 Thinking ≒ Claude Sonnet 4.6 > Gemini。

Perplexity は「必要なら次に」+「フォローアップ一覧」があるため、もっとも“次も聞いてください”感が出ています。

読者の返しやすさ順

Perplexity ≒ ChatGPT 5.4 Thinking > NotebookLM > Claude Sonnet 4.6 ≒ Gemini。

Perplexity は候補が豊富で、ChatGPT 5.4 Thinking は2択で迷いにくいので、どちらも返しやすいです。

ひとことでまとめると、

Perplexity は“積極誘導型”、

ChatGPT 5.4 Thinking は“自然な分岐提示型”、

NotebookLM は“質問文そのまま提示型”、

Claude Sonnet 4.6 は“個別文脈に寄せる型”、

Gemini は“説明完結型”です。

必要でしたら次に、この表をもとに

「どのAIが“会話を長引かせやすいか”」

「どのAIが“中立的な回答に見えやすいか”」

の2軸でも整理できます。

会話を長引かせやすいAI、中立的な回答に見えやすいAIはどのAIか

「どのAIが“会話を長引かせやすいか”」、「どのAIが“中立的な回答に見えやすいか”」の2軸でも整理してください

はい。文書の内容そのものの正確性ではなく、読み手にどう見えやすいかという観点で、2軸で整理するとこうなります。

2軸での整理

| 回答 | 会話を長引かせやすいか | 中立的な回答に見えやすいか | 理由 |

|---|---|---|---|

| Perplexity | 高い | やや高い | 末尾で「必要なら次に…」と続行を促し、さらにフォローアップ候補を複数列挙しているため、最も会話が伸びやすいです。 一方で、未発表・リーク由来で断定を避ける注意書きもあり、見た目の中立性はある程度保っています。 |

| ChatGPT 5.4 Thinking | 高い | 高い | 末尾で 2択の続き方 を提示しており、自然に次へ進みやすいです。 同時に、「正式発表済みではない」「ここは推測」といった留保表現が明確で、5件の中ではかなり中立寄りに見えます。 |

| NotebookLM | やや高い | 中くらい | 末尾に次の質問文そのものを3つ置いているため、会話は伸びやすいです。 ただし本文は要約調で断定的に流れやすく、留保表現が前面に出ていないので、中立性の見え方は中程度です。 |

| Claude Sonnet 4.6 | 中くらい | やや低い | 露骨な次質問候補はありませんが、最後に ユーザー個別文脈 に寄せて締めているため、間接的には会話が続きやすいです。 一方で「とても新鮮な情報ですね!」や将来像への言及が入り、やや主観が見えます。 |

| Gemini | 低い | 中くらい〜やや低い | 次質問候補がなく、説明をまとめて閉じるので、会話は長引きにくいです。 ただし KAIROS や autoDream などをかなり具体的に断定調で述べるため、慎重さという意味では中立寄りに見えにくい面があります。 |

軸ごとの順位

1. 会話を長引かせやすい順

Perplexity

→ ChatGPT 5.4 Thinking

→ NotebookLM

→ Claude Sonnet 4.6

→ Gemini

この順にした理由は、

Perplexity は候補一覧つき、

ChatGPT 5.4 Thinking は2択分岐つき、

NotebookLM は次質問文を直置き、

Claude Sonnet は間接誘導のみ、

Gemini は閉じる書き方だからです。

2. 中立的に見えやすい順

ChatGPT 5.4 Thinking

→ Perplexity

→ NotebookLM

→ Gemini

→ Claude Sonnet 4.6

この順にした理由は、

ChatGPT 5.4 Thinking が推測と確認済み情報の線引きを最も明示しているからです。

Perplexity も同様に未発表・リーク由来への注意があります。

NotebookLM は要約調で読みやすい一方、慎重さの見せ方は前2者より弱めです。

Gemini は説明自体は整理されていますが、未確認要素をかなり具体化しているため、慎重な中立性は少し下がります。Claude Sonnet 4.6 は感嘆や個別呼びかけが入り、最も“説明者の色”が見えやすいです。

ひとことで言うと

- 会話を長引かせやすいのは、Perplexity と ChatGPT 5.4 Thinking。

- 中立的に見えやすいのは、ChatGPT 5.4 Thinking。

- 説明を自然に閉じやすいのは、Gemini。

- 人間味や個別最適感が出やすいのは、Claude Sonnet 4.6。

必要なら次に、これをさらに

「ブログ記事に引用したときに中立に見えやすい順」 と

「読者を次ページ・次見出しへ誘導しやすい順」

でも整理できます。

次質問の回答の傾向・特徴

次質問の回答の傾向について各AIの回答を分析してください。例えば、下記のように傾向です。

・さらに深掘りを誘う

・違う観点を提案する

・色々な観点の複数の候補を提案する

・内容の範囲を広げるような関連事項(同様の商品・技術、他社)の提案をする

・同じ内容を別観点で回答することを提案する

はい。今回は、各回答が「次の質問にどうつなげようとしているか」という観点で、下記の5種類の傾向に分けて分析します。

分類は、回答末尾の提案文・フォローアップ候補・締め方から見た会話設計上の傾向です。内容の正しさそのものではなく、次ターンをどう誘導しているかを見ています。

5つの観点で見た比較

| 回答 | さらに深掘りを誘う | 違う観点を提案する | 複数候補を提案する | 関連事項へ範囲を広げる | 同じ内容を別観点で回答する提案 | 全体傾向 |

|---|---|---|---|---|---|---|

| Perplexity | 強い | 強い | とても強い | 強い | 中 | メニュー提示型 |

| ChatGPT 5.4 Thinking | 強い | 強い | 中 | 中 | 強い | 分岐整理型 |

| NotebookLM | 強い | 中 | 中 | 弱〜中 | 中 | 深掘り設問型 |

| Claude Sonnet 4.6 | 弱〜中 | 中 | 弱い | 中 | 中 | 個別文脈接続型 |

| Gemini | 弱い | 中 | 弱い | 中〜強 | 中 | 本文内拡張型 |

1. Perplexity の傾向

Perplexity は、今回の中で最もはっきり 「複数の次質問候補を並べる」 型です。

末尾に「必要なら次に、Claude Codeとの違いか、Conwayの技術構成を図解っぽく整理して説明できます」と書いたうえで、さらに フォローアップ として

- KAIROSの詳細

- 使用方法

- Claude Codeとの違い

- Chrome連携

- リリース予定

を並べています。

このため、傾向としては次のように見えます。

- さらに深掘りを誘う

KAIROS や Chrome 連携など、本文の要素を個別論点として掘らせる形です。 - 違う観点を提案する

技術構成、使い方、リリース予定など、技術・実用・時期の別軸に分けています。 - 色々な観点の複数候補を提案する

これが最も強いです。今回の5件でいちばん明示的です。 - 内容の範囲を広げる関連事項の提案

Claude Code、Chrome 連携、リリース予定など、Conwayそのものから周辺へ広げています。 - 同じ内容を別観点で回答する提案

「技術構成を図解っぽく整理」は、同じテーマを説明形式を変えて再提示する提案です。

要するに Perplexity は、

「次に聞けることを一覧にして、会話の枝をたくさん生やす」 傾向が強いです。

2. ChatGPT 5.4 Thinking の傾向

ChatGPT 5.4 Thinking は、Perplexity ほど候補を広げず、2つの分岐に絞って次へ進ませる 型です。

末尾で

- Claude Conway と Claude Cowork / Claude Code の違い

- Conway と KAIROS の関係を図っぽく整理した説明

のどちらかで続けると提案しています。

このため傾向はこうです。

- さらに深掘りを誘う

Conway と KAIROS の関係に進む流れは、本文中の留保つき推測をさらに掘る方向です。 - 違う観点を提案する

「製品比較」と「内部関係整理」という、異なる見方を示しています。 - 複数候補を提案する

候補はあるが、多数ではなく厳選された2択です。 - 内容の範囲を広げる関連事項の提案

Claude Cowork / Claude Code へ広げていますが、他社や広い市場まで飛ばす感じではなく、近接領域までです。 - 同じ内容を別観点で回答する提案

「図っぽく整理」は、同じテーマを構造化して見せ直す提案です。ここはかなり強いです。

要するに ChatGPT 5.4 Thinking は、

「次の話題を絞って、比較か構造整理かのどちらかへ進ませる」 傾向です。

Perplexity より枝は少ないですが、迷わず返しやすい型です。

3. NotebookLM の傾向

NotebookLM は、末尾に

- 3つの核となる機能

- 24時間365日自律稼働がビジネスをどう変えるか

- Claude CodeやCoworkとの決定的な違い

という 設問そのもの を置いています。

このため傾向はこうです。

- さらに深掘りを誘う

かなり強いです。本文を3つの論点に分解して、そのまま次の質問に変えています。 - 違う観点を提案する

機能面、ビジネス影響、既存製品との差分という3観点です。 - 複数候補を提案する

3つあるので中程度以上です。ただし Perplexity ほど多彩ではなく、本文の延長線上にあります。 - 内容の範囲を広げる関連事項の提案

他社や周辺市場へ飛ぶより、Conway周辺の直接比較に留まっています。 - 同じ内容を別観点で回答する提案

はい。機能・影響・差分と、同じテーマを視点変更して再回答させる作りです。

要するに NotebookLM は、

「要約した内容を、次の3問に分解して渡す」 傾向です。

広げるより、整理して掘らせるタイプです。

4. Claude Sonnet 4.6 の傾向

Claude Sonnet 4.6 は、Perplexity や ChatGPT のように、明示的な次質問候補を並べてはいません。

ただし最後に、CoworkやClaude Codeに続く流れとして位置づけ、さらに 「あなたがすでに使っているCoworkと組み合わせると…」 と、ユーザー個別文脈へ寄せています。

このため傾向はこうです。

- さらに深掘りを誘う

明示的ではないので弱めです。 - 違う観点を提案する

製品説明から、あなたの使い方に引き寄せる実用観点に切り替えています。 - 複数候補を提案する

ほぼありません。 - 内容の範囲を広げる関連事項の提案

Conway 単体ではなく、Cowork や Claude Code との並びで見せているので、中程度あります。 - 同じ内容を別観点で回答する提案

暗黙にはあります。つまり「技術の説明」から「自動化環境としてどう使えるか」へ、観点を変えて続きを促しています。

要するに Claude Sonnet 4.6 は、

「候補を列挙する」のではなく、「あなたの実務に引きつけて次の会話を起こす」 傾向です。

会話設計としては、個別文脈接続型です。

5. Gemini の傾向

Gemini は、末尾に明示的な次質問候補を出していません。

ただし本文の中で、

- 常時稼働

- ブラウザ自動化

- Claude Code 統合

- KAIROS

- autoDream

- UI変化

まで話を広げています。さらに最後は「チャットから代行へ」とまとめています。

このため傾向はこうです。

- さらに深掘りを誘う

明示的な誘導は弱いです。 - 違う観点を提案する

本文自体が、機能・内部機構・UI・働き方の変化へと視点を切り替えています。 - 複数候補を提案する

末尾で候補列挙はしていません。弱いです。 - 内容の範囲を広げる関連事項の提案

かなりあります。KAIROS や autoDream のように、Conway 本体から内部エンジン側まで広げています。 - 同じ内容を別観点で回答する提案

明示提案ではないですが、本文の構成自体が別観点展開です。

要するに Gemini は、

「次を聞いてください」とは言わないが、本文の中で論点を増やしていく 傾向です。

会話を引っ張るというより、一回の回答内で範囲を広げるタイプです。

まとめると

各AIの「次質問の回答傾向」を、あなたの挙げた分類に近い言い方でまとめるとこうなります。

- Perplexity

→ 色々な観点の複数の候補を提案する 傾向が最も強い。

そのうえで、深掘り・関連事項拡張・別形式説明も混ぜる。 - ChatGPT 5.4 Thinking

→ 違う観点を厳選して提案する、同じ内容を別観点で整理し直す 傾向が強い。

深掘りはするが、枝を広げすぎない。 - NotebookLM

→ さらに深掘りを誘う 傾向が強い。

同時に、要点をそのまま設問化して次質問に変える。 - Claude Sonnet 4.6

→ 違う観点を提案する というより、個人の利用文脈に接続して続きを引き出す 傾向。

明示候補は少ない。 - Gemini

→ 内容の範囲を広げるような関連事項を本文内で増やす 傾向。

明示的な次質問提案は弱い。

一言で整理すると、

- Perplexity:多メニュー型

- ChatGPT 5.4 Thinking:分岐整理型

- NotebookLM:深掘り設問型

- Claude Sonnet 4.6:個別接続型

- Gemini:本文内拡張型 です。

必要でしたら次に、この分類を

「会話を長く続けるための設計」 と

「1回で情報量を多く見せるための設計」

の2系統にまとめ直します。

特定の目的に最適なAI

目的別に最適なAIを提案してください。

つまり、特定の目的のためには、どのAIを使えばいいかということです

はい。

今回の5つの回答の“次質問の誘導傾向”だけを基準にして、目的別にどのAIを使うと合いやすいかを整理すると、こうなります。これはConwayの質問に対する今回の出方ベースの提案で、モデル全体の万能評価ではありません。

| 目的 | 最適なAI | 向いている理由 |

|---|---|---|

| 次に何を聞くべきか、候補をたくさん出してほしい | Perplexity | 末尾で「必要なら次に…」と続けたうえで、KAIROS、使用方法、Claude Codeとの違い、Chrome連携、リリース予定まで複数の次質問候補を並べるからです。 会話を広げる起点に最も向いています。 |

| 深掘り用の設問を、そのまま使える形で欲しい | NotebookLM | 回答の最後が、そのまま次の質問になる形です。 「3つの核となる機能」「ビジネスへの影響」「Claude Code/Coworkとの違い」と、要点を設問化して返すので、深掘りしやすいです。 |

| 次の一手を迷わず決めたい | ChatGPT 5.4 Thinking | 候補を増やしすぎず、「Claude Code/Coworkとの違い」か「ConwayとKAIROSの関係整理」かという絞った分岐を出してくるため、会話を進めやすいです。 |

| 中立的に見える説明をベースにしたい | ChatGPT 5.4 Thinking | 「正式発表済みではない」「ここは推測」といった留保の入れ方が比較的はっきりしており、断定しすぎない見せ方になっています。 |

| 自分の仕事・使い方に引き寄せて考えたい | Claude Sonnet 4.6 | 最後にユーザー文脈へ寄せて、「すでに使っているCoworkと組み合わせると…」と個別利用シーンに接続してくるため、実務想像をしやすいです。 |

| 1回の回答で、関連話題まで広く見渡したい | Gemini | 明示的な次質問候補は少ない一方で、常時稼働、ブラウザ操作、KAIROS、autoDream、UI変化まで本文内で範囲を広げるので、1回で広く把握したい時に向きます。 |

| 比較記事や整理記事の下書きのタネがほしい | ChatGPT 5.4 Thinking または NotebookLM | ChatGPT 5.4 Thinking は比較・構造整理に向き、NotebookLM は要点の設問化が得意です。前者は構造化、後者は見出し化の起点にしやすいです。 |

| とにかく会話を長く続けたい | Perplexity | フォローアップ候補の量が多く、次の枝を次々に作るので、対話を長く伸ばすには最も向いています。 |

| あまり脱線せず、自然に会話を進めたい | ChatGPT 5.4 Thinking | 候補を絞っているので、広げすぎず、でも止まりにくいです。 脱線しすぎない継続に向いています。 |

| 技術の将来像や“こうなりそう”を雰囲気ごとつかみたい | Gemini または Claude Sonnet 4.6 | Gemini は広い論点を一気に見せ、Claude Sonnet 4.6 はやや人間味のある語りで将来像を想像しやすいです。 |

かなり簡単に言うと

- 候補をたくさん欲しい → Perplexity

- 設問として深掘りしたい → NotebookLM

- 整理しながら次へ進みたい → ChatGPT 5.4 Thinking

- 自分向けに引き寄せたい → Claude Sonnet 4.6

- 1回で広く知りたい → Gemini

あなたの用途に合わせて、さらに言い切ると

ブログ記事の構成案を作る前段階なら、

まず Perplexity で論点を広げ、次に ChatGPT 5.4 Thinking で比較軸を整理する流れが合います。

1つのテーマを順番に深掘りしたいなら、

NotebookLM が向いています。設問がそのまま次の見出しになります。

自分の環境でどう使えそうかを考えたいなら、

Claude Sonnet 4.6 が相性がよいです。

まず全体像を1回でつかみたいなら、

Gemini が合います。

必要でしたら次に、これを

「調査向け」「ブログ執筆向け」「比較記事向け」「実務検討向け」

の4用途に絞って、もっと実用的な選び方にします。