Arduino UJNO Qを紹介する下記YouTube動画を見つけた。2時間以上ある動画なので、以前に作成した下記ブログ記事に記載していない内容を調べることにした。

(注)本記事の内容は正確性を保証するものではない。

(2025年12月15日 追記)YouTube動画を追加しました。 https://youtu.be/KZaE_kQIbdQ

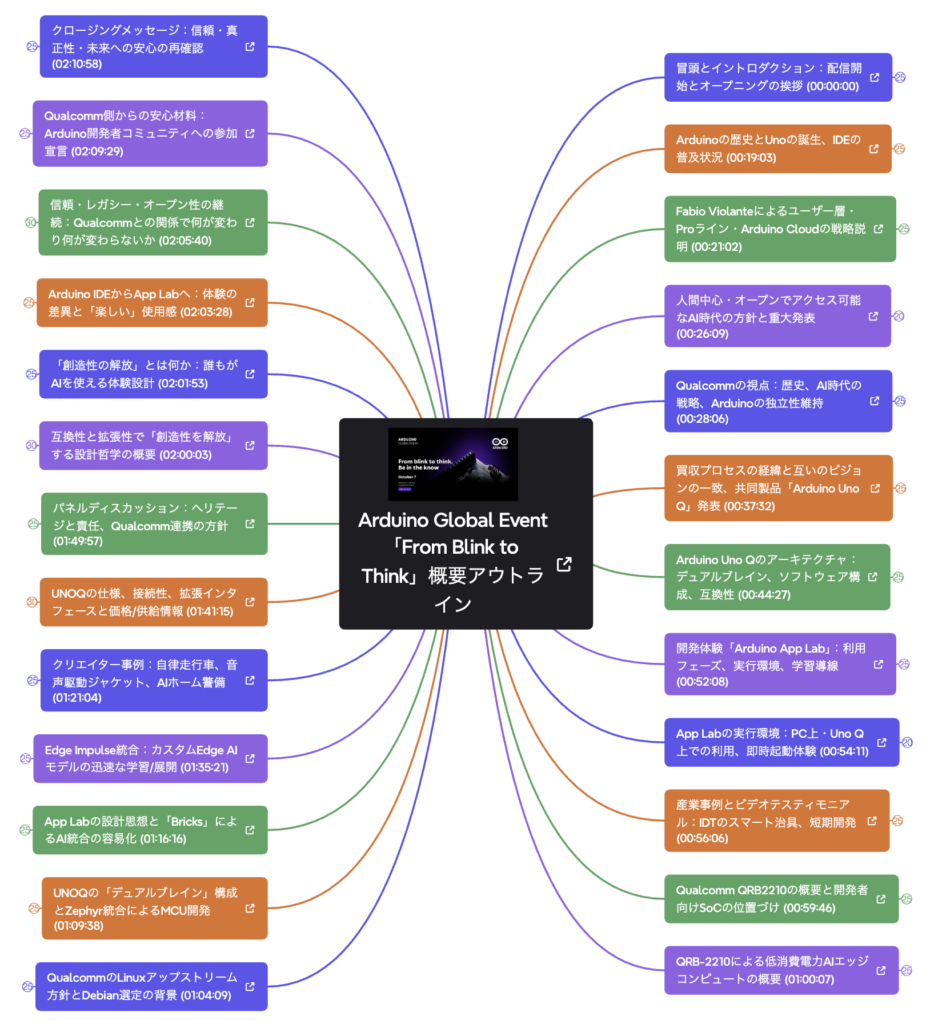

YouTube動画の概要

動画が長いので、どのような内容があるか概要を調べたところ、活用事例、開発期間短縮、省電力などの話題もあることが分かったが、まずは、先に紹介したブログ記事との差分内容について調べた。Gemini 3 ProとChatGPT 5.2 Thinkingを使って調べたが、Gemini 3 Proの回答の方が全体のまとまりがよかったので、先にGemini 3 Proの回答を紹介する。

ブログ記事に記載されていない内容(Gemini 3 Pro回答編)

添付ファイルは、Arduino UNO Qに関する動画内容の資料です。

添付ファイルに記載された事項のうち、下記URLのブログ記事に記載されていない事項、または、そのブログ記事で示唆されているが詳細は記載されていない事項を回答してください。

https://roompine.com/uno-q-with-arduino-app-lab-1/

Gemini 3 Proの回答

ご提示いただいた動画の概要資料(添付ファイル)と、指定されたブログ記事(https://roompine.com/uno-q-with-arduino-app-lab-1/)の内容を比較・分析しました。

ブログ記事はスペックや一般的な特徴、他機種との比較を中心によくまとめられていますが、動画資料に含まれる「開発の背景・哲学」「具体的なビジネス戦略」「詳細なデモ事例」「特定の技術用語」などに関する記述が不足または不在でした。

ブログ記事に記載がない、または詳細が不足している主な事項は以下の通りです。

1. Qualcomm買収後の組織体制と「マルチベンダー方針」の維持

ブログではQualcommによる買収の事実には触れていますが、動画内で強調された以下の戦略的詳細やコミュニティへの約束については記載がありません。

- 独立子会社としての運営: ArduinoはQualcomm内部の「独立子会社」として運営され、オープンソース精神やコミュニティ文化を維持することが明言されています。

- マルチベンダー支援の継続: Qualcommのシリコン(QRB2210)を採用しつつも、Arduinoは「特定のベンダーに限定しないオープンな姿勢」を堅持し、他社シリコンベンダーのサポートも継続すると約束しています。

- 「安全な手」というメッセージ: 買収がエコシステムに悪影響を与えないよう配慮されている点や、Edge Impulseの買収事例(独立性を維持している)を引き合いに出した説明が欠けています。

2. 具体的な価格設定

ブログ記事ではストアへのリンクや発売時期への言及はありますが、動画内で発表された具体的な価格設定については明記されていません。

- Entryモデル(2GB RAM/16GB): 39ユーロ(または44ドル)。

- Advancedモデル(4GB RAM/32GB): 53ユーロ(または59ドル)。

- 動画ではこれを「信じられない価格」とし、普及を狙う戦略的な価格設定であることが語られています。

3. App Labのユーザー体験フレームワーク「Play, Tinker, Learn, Master」

ブログではApp Labの機能(PythonとSketchの統合、Bricks)には触れていますが、動画で提示された4段階の学習・利用フェーズという概念的な枠組みについては記載がありません。

- Play: プリメイドされた例をコードなしで実行し、体験するフェーズ。

- Tinker: 例の一部を編集・調整し、挙動の変化を学ぶフェーズ。

- Learn: ドキュメントやチュートリアルで体系的に学ぶフェーズ。

- Master: ゼロから独自のアプリを構築するフェーズ。

4. 具体的な導入事例・デモ(Case Studies)

ブログでは「代表ユースケース」として一般的な用途(AIカメラ、センサロギング等)が挙げられていますが、動画で紹介された具体的なパートナー企業やクリエイターによる実例の詳細がありません。

- 産業事例(IDT Solutions): 自動車内装部品の検査を行う「スマート治具」の開発において、通常数ヶ月かかる工程を数日に短縮した事例。品質検査(ビジョン)と操作盤(HMI)を1枚のボードで統合した点が強調されています。

- クリエイター事例(自律走行車): 顔検出Brickを使い、Arduinoコードでステアリングと速度をPID制御する自作車両のデモ。

- クリエイター事例(ロボティック・ジャケット): 音声ウェイクワード「Hey, Arduino」で服の装飾(花)が動くファッションテック作品。

5. 技術的な詳細:Zephyrの「Linkable Loadable Extensions」

ブログではMCU(STM32)側の制御について「Arduino IDEで書き込む」「Bridgeで連携」といった記述にとどまっていますが、動画ではより踏み込んだ技術的な仕組みが語られています。

- Linkable Loadable Extensions: Zephyr RTOS上で、基盤ファームウェアを書き換えることなく、ユーザーのスケッチを「動的にデプロイ(追加ロード)」して実行する仕組み。これにより、クリティカルなタスクを止めることなくアプリの入れ替えが可能になると説明されています。

6. ハードウェア設計の制約:「1W電力枠」と「ファンレス」

ブログでも低消費電力であることには触れられていますが、動画では設計思想としてより強く語られています。

- 全ての機能を「約1Wの電力枠内」で動作させることを目標とし、それによって「ファンレス設計」を実現したという具体的な数値目標と、それがもたらす信頼性(広温度動作、密閉筐体への組み込みやすさ)についての詳細な背景。

下記の事項についての説明を回答してください。

・産業事例とビデオテスティモニアル:IDTのスマート治具、短期開発 (00:56:06)

・クリエイター事例:自律走行車、音声駆動ジャケット、AIホーム警備 (01:21:04)

・例示デモ:音声ウェイクワードや顔検出の応用 (01:25:04)

・実演:ステージ上での顔検出モデルの即時作成 (01:37:37)

・マルチモダリティ対応と産業別ユースケース例 (01:39:42)

・[クリエイター事例:自律走行車、音声駆動ジャケット、AIホーム警備 (01:21:04)

・[顔追跡AIで操舵・駆動を制御する乗用カープロジェクト (01:22:31)

・音声ウェイクワードで動くロボティック・フラワージャケット (01:27:28)

・[AI人間検出によるホームセキュリティの試作 (01:30:36)

・ツール貸出管理システム:RFID+顔撮影+メール送信 (01:32:34)

Gemini 3 Proの回答

ご提示いただいた動画の概要資料に基づき、ご指定の各トピック(産業事例、クリエイター事例、デモ、実演など)について詳細を解説します。

1. 産業事例:IDT Solutionsのスマート治具 (00:56:06)

産業パートナーであるIDT Solutionsが、UNO Qを用いて自動車内装部品の検査装置(スマート治具)を開発した事例です。

- 開発期間の短縮: 通常、こうした産業用システムの開発には数ヶ月を要しますが、UNO Qのハード・ソフトの使いやすさにより、わずか数日でプロトタイプから製品化レベルまで完成させました。

- システムの統合: 従来はPLC(プログラマブルロジックコントローラ)や複数の機器が必要だった機能を、UNO Q一枚に集約しました。具体的には、ロボットアームに取り付けたカメラによる「品質・部品存在検査(ビジョン)」と、作業者が操作する「HMI(操作画面)」を同一ボード上で動作させています。

- 現場での柔軟性: 小型で全機能が集約されているため、工場のライン変更や配置換えにも柔軟に対応できる機動性が確保されています。

2. クリエイター事例とプロジェクト詳細 (01:21:04以降)

UNO Qの「デュアルブレイン(MCUによる制御+MPUによるAI/高位処理)」を活用した具体的な作品事例です。

- 顔追跡AIで操舵・駆動を制御する乗用カー (01:22:31)

- 仕組み: 顔検出「Brick」(App Labの機能ブロック)を使用し、検出した顔のX座標やサイズ情報をArduinoコードへ渡します。Arduino側ではPID制御を用いてステアリング(操舵)と速度(ESC制御)を調整し、人を追従して走る自律走行を実現しています。

- 特徴: 100ピクセル未満の小さな検出は無視するなど、誤作動防止のロジックも組み込まれています。

- 音声ウェイクワードで動くロボティック・フラワージャケット (01:27:28)

- 仕組み: 「Hey, Arduino」というウェイクワード(起動語)をオンデバイスAIが認識すると、ジャケットに取り付けられたロボットの花が動作します。

- 特徴: クラウドに依存しないため、屋外やイベント会場などのオフライン環境でも安定して動作します。ファッションとテクノロジーを融合させた事例です。

- AI人間検出によるホームセキュリティ (01:30:36)

- 仕組み: Webカメラ映像からAIが「人間」のみを検出し、猫などのペットは無視します。侵入者を検知するとブザーを鳴らします。

- 特徴: セキュリティのオン/オフ(アーム/ディスアーム)は、Webブラウザ上のUIから操作できるほか、Modulino(拡張モジュール)の物理ボタンでも操作可能で、ネットワークと物理操作の両立が図られています。

- ツール貸出管理システム (01:32:34)

- 仕組み: 工房などで工具を貸し出す際の管理システムです。RFIDリーダーで工具タグを読み取ると同時に、カメラで借りる人の顔写真を撮影し、データベースへの記録とメール送信を行います。

- 特徴: センサー制御(MCU)と、画像処理・データベース・メール通信(MPU/Linux)という異なる性質の処理を、UNO Q一枚で完結させています。

3. 例示デモとApp Labの体験 (01:25:04)

開発環境「App Lab」に用意されているサンプルの特徴と、学習プロセスの設計についての説明です。

- 統合されたサンプル: App Labの例(Example)は単なるコード断片ではなく、Pythonスクリプト、Arduinoスケッチ、AIモデルがセットになった「すぐに動くアプリケーション」として提供されます。

- 学習の4段階: ユーザーは以下のステップで自然にスキルアップできるよう設計されています。

- Play: 例をそのまま実行して楽しむ。

- Tinker: パラメータなどを少し変更してみる。

- Learn: ドキュメントで仕組みを学ぶ。

- Master: ゼロから自分でアプリを作る。

4. 実演:ステージ上での顔検出モデル即時作成 (01:37:37)

Edge Impulseと連携し、カスタムAIモデルをその場で作成するライブデモです。

- プロセス: ステージ上でカメラを使ってデータを収集し、AI支援機能でラベリングを行い、「YOLO Pro Nano」モデルの学習を実行しました。

- 展開: 学習完了後、作成したモデルをUNO Qへ即座にデプロイ(展開)し、ライブで顔検出が動作する様子を実演しました。これにより、専門知識がなくても現場のデータを使って短時間でAIモデルを作れることを証明しました。

5. マルチモダリティ対応と産業別ユースケース (01:39:42)

映像、音声、センサーデータなど複数の種類(モダリティ)のデータを扱うAIの応用例です。

- Wearables (ウェアラブル): オンデバイスで推論を行うためプライバシーが守られ、健康データの解析や動作認識などを低遅延で行えます。

- Automotive (自動車): 車内カメラやマイクを使い、運転手の集中度監視や、機械の異音検知などをオフラインで即座に行い、安全性を向上させます。

- Industrial (産業): 工場のラインにおいて、カメラ映像や振動センサーのデータを組み合わせ、欠陥検出や予知保全を行います。汎用モデルではなく、現場特有の照明や条件に合わせて学習させた「カスタムモデル」の重要性が強調されています。

下記の各事項に関する説明を抽出し箇条書きにしてください。

・開発期間の短縮、開発期間の短さ

・省電力、低消費電力

・ハードウェア及びソフトウェアの使いやすさ、利便性

Gemini 3 Proの回答

ご提示いただいた資料に基づき、各テーマに関する記述を抽出・整理しました。

開発期間の短縮、開発期間の短さ

- 産業事例における劇的な短縮: パートナー企業(IDT Solutions)は、通常数ヶ月かかる製品ライフサイクルを、Uno Qを活用することで数日へと短縮しました。

- 迅速な反復開発(イテレーション): Zephyr RTOSの機能を活用し、ユーザーが記述したアプリケーションコードだけを動的にリンク・デプロイできるため、開発の反復速度が大幅に向上します。

- AIモデル開発の高速化: Edge ImpulseとApp Labの統合により、データ収集・学習・評価・展開の一連のフローを短い反復で回せるため、現場適応やモデル改善のサイクルを短縮できます。

- 製品開発のスピード: アイデアから実装までの時間を短縮するため、クラウド、AI、接続性の統合によって開発プロセス自体を容易化しています。

- 共同開発の実績: ArduinoとQualcommの共同開発プロジェクト自体も、約9ヶ月(一部言及では6ヶ月)という短期間で成果(Uno Qおよびソフトウェア基盤)を出し、スピード感のある開発が実践されました。

省電力、低消費電力

- 1Wクラスの動作目標: 全機能を約1Wの電力枠内で動作させる設計により、ファンレスかつバッテリー駆動のデバイス開発を容易にしています。

- ロボティクス向けの要件: ロボット用途でのワークロードを「1.2Wでファンレス運用したい」という具体的要件に基づき、プロセッサ(Qualcomm QRB2210)が選定されました。

- スリープ時の処理継続: 低消費電力DSPを搭載しており、メインプロセッサがスリープしている間でも音声やオーディオ処理(ウェイクワード検出など)を継続して実行可能です。

- 熱設計の有利さ: 低消費電力であるため発熱が少なく、密閉されたエンクロージャや屋外環境での長期的かつ安定的な運用に適しています。

- 接続性の最適化: Wi-FiやBluetoothなどの接続機能においても電力と性能の最適化が図られており、バッテリー駆動のユースケースでも安定したリンクを維持しやすくなっています。

ハードウェア及びソフトウェアの使いやすさ、利便性

- 統合開発環境「App Lab」: Pythonスクリプト、Arduinoスケッチ、AIモデルを一つの開発体験に統合し、Dockerコンテナなどの複雑な環境構築を隠蔽することで、ユーザーがコード作成に専念できるようにしています。

- 即時起動(Out of the Box)体験: 電源投入後すぐにプリインストールされた例(Example)が動作する設計になっており、設定の煩雑さを排して学習やデモの準備負担を軽減します。

- 「Bricks」による機能追加: AIモデルやデータベースなどの高度な機能を「積み木」のようにプロジェクトに追加するだけで利用でき、複雑なセットアップなしで高度なアプリを構築可能です。

- デュアルブレインの抽象化: Linux(MPU)とマイコン(MCU)間の複雑な通信を「Arduino Bridgeライブラリ」が抽象化しており、開発者は両者の連携を容易にプログラムできます。

- ハードウェアの互換性と拡張性: 従来のUnoフォームファクタを維持しているため既存のシールド資産が活用できるほか、Quickコネクタによるセンサー接続や、配線不要で拡張できる設計が採用されています。

- 標準Debian Linuxへの対応: 独自のLinuxではなく標準的なDebianを採用することで、豊富なパッケージ(apt)や既存のLinux開発ツール、Pythonエコシステムをそのまま利用でき、学習コストを下げています。

- ユーザー体験(UX)の重視: 「5分でケーブルを刺してクリックで動く」という直線的な体験を重視し、ドライバやファームウェア更新などの面倒な作業を裏側に隠蔽しています。

以降、ChatGPT 5.2 Thinkingの回答

ブログ記事に記載されていない内容(ChatGPT 5.2 Thinking回答編)

添付ファイルは、Arduino UNO Qに関する動画内容の資料です。

添付ファイルに記載された事項のうち、下記URLのブログ記事に記載されていない事項、または、そのブログ記事で示唆されているが詳細は記載されていない事項を回答してください。

https://roompine.com/uno-q-with-arduino-app-lab-1/

ChatGPT 5.2 Thinkingの回答

以下は、添付資料(動画アウトライン)に書かれているのに、指定ブログ記事には「未記載」または「示唆はあるが詳細なし」のポイントです(※ブログ側の“触れ方”も併記します)。

1) 背面ソケット(拡張)の具体像:Quick / Carrier / Modulinos

- Quickコネクタ(I2C拡張)

添付資料:I2Cベースでセンサー/アクチュエータ(Modulinos含む)を接続でき、デイジーチェーンで最大50まで拡張可能。

ブログ:Quick自体の説明や「最大50」などの具体が見当たりません。 - Arduino Carrier(背面の高速コネクタ)で何が出てくるか

添付資料:Carrier高速度コネクタで Qualcomm側の高速GPIOへ直接アクセスでき、MIPI-CSI/DSI・オーディオなどに対応。

ブログ:「高速ヘッダで周辺機器を接続可能」と“できる”ことの示唆はありますが、MIPI/オーディオ/高速GPIO直結などの具体は書かれていません。 - Modulinoを使ったデモ構成(MCUクリティカル処理+Web可視化)

添付資料:Modulinoセンサで閾値判定→危険時LED点灯の常駐クリティカルタスクをMCUで回しつつ、MPU側PythonでWeb表示、さらにZephyr API経由でMCUプロセス一覧を取得して可視化する…という“構成の具体”があります。

ブログ:一般的なユースケース説明はありますが、この手のプロセス可視化デモの具体は見当たりません。

2) MCU側:Zephyr統合と「動的デプロイ(LLE)」の話

- Arduino Core on Zephyr の狙い(RTOS基盤の上にArduino体験を載せる)

添付資料:Zephyrを“MCU版Linux”的に位置づけ、スケジューラ/サービス/APIの上にArduinoコアを構築する意義が説明されています。

ブログ:Bridge/RPC連携は説明されていますが、MCU側がZephyr前提でどう変わるか(APIや設計の思想)はほぼ触れていません。 - Linkable Loadable Extensions(LLE)で“スケッチだけ”動的展開

添付資料:検証済みの基盤FWの上に、スケッチ(アプリコード)を動的に展開して即時有効化、IDE/App Labから高速に再デプロイ、クリティカルタスクと共存…という具体。

ブログ:この「MCU側を丸ごと焼かずに差分だけ」「OS管理下で安全に追加」などの話は出てきません。 - SBOM対応(Cyber Resilience Actを見据えた透明性)

添付資料:ZephyrがSBOM生成をサポートし、規制を見据えた透明性/セキュリティ管理に寄与する旨。

ブログ:SBOMや規制対応の観点は見当たりません。

3) Linux側:Debian採用の理由・アップストリーム方針・量産/OTAへの“現実的移行”

- Debian Trixie追従+デルタ最小化(kernel/Mesa/U-Boot)

添付資料:上流乖離を避け、Debian Trixieを追跡しつつ kernel/Mesa/U-Boot を含めて差分最小化、上流受理が品質/長期保守の裏付け…という説明。

ブログ:Linuxという事実は書かれていますが、Debian採用理由や upstream-first の設計思想は詳述されていません。 - 開発はDebianで高速に、量産・OTAはYocto/Foundries/Qualcomm SaaSへ

添付資料:プロトタイプ→量産/運用の現場での移行パス(Yocto/Foundries/SaaS管理)を明言しています。

ブログ:SBC運用やNetwork運用の話はありますが、量産・OTA運用へどう繋ぐかは書かれていません。 - Xfce採用など“開発体験”の具体

添付資料:DebianベースでXfceを採用したシンプルなデスクトップ等、UX設計の具体があります。

ブログ:GUI/デスクトップ環境の具体(Xfce等)は見当たりません。

4) Bricks:ブログが“存在”を言う一方、添付資料は「中身の仕組み」まで踏み込む

- Brick=Pythonライブラリ+シンプルAPI+Dockerコンテナ自動展開

添付資料:AIモデル込みのDockerコンテナを依存関係込みで自動展開し、面倒な環境構築なしで機能追加できる、という“実装の肝”。

ブログ:Bricksを追加する流れはありますが、Docker自動展開などの内情は書かれていません。 - プリロード済みモデル(物体検出/音認識/異常検知)+検索/DLで即利用

添付資料:UNO Qにプリロードされたモデルをフィルタ/検索/ダウンロードしてすぐ使える。

ブログ:この“プリロードモデルの扱い”は見当たりません。 - Edge Impulse連携(自前データで学習→取り込みがシームレス)

添付資料:カスタムモデルで現場適応できるワークフローの言及。

ブログ:Edge Impulse連携の具体は見当たりません。 - 具体デモ例(ウェイクワード/顔検出→PID+サーボ/人だけ検出の防犯)

添付資料:「Hey, Arduino」トリガー、顔検出のバウンディングボックスをArduino側へ渡してPID/サーボ制御、人間のみ検出+Web UI+物理ボタン操作など。

ブログ:代表ユースケースはあるものの、ここまでの“作り方が想像できる粒度”の例示はありません。

5) 価格・供給スケジュール(モデル別の具体)

- 添付資料:Entry(2GB/16GB)は39ユーロ or 44ドルで注文開始→10/24出荷予定、上位(4GB/32GB)は53ユーロ or 59ドルで11月注文開始→年内出荷予定。

- ブログ:RAM/ストレージ構成の話はありますが、価格・出荷日・注文開始時期は見当たりません。

6) “オープン性”の扱い(ライセンス公開の明言)

- 添付資料:基板レイアウトと回路図をオープンソースライセンスで公開、App Labやサンプル群もオープンライセンスで提供、という明確な説明。

- ブログ:回路図PDF等のリンク案内はありますが(資料参照の導線はある)、「オープンソースライセンスで公開する」という思想・位置づけは明記されていません。

添付ファイルは、Arduino UNO Qに関する動画内容の資料です。

添付ファイルに記載された事項のうち、下記URLのブログ記事に記載されていない事項、または、そのブログ記事で下記の事項についての説明を回答してください。

・産業事例とビデオテスティモニアル:IDTのスマート治具、短期開発 (00:56:06)

・クリエイター事例:自律走行車、音声駆動ジャケット、AIホーム警備 (01:21:04)

・例示デモ:音声ウェイクワードや顔検出の応用 (01:25:04)

・実演:ステージ上での顔検出モデルの即時作成 (01:37:37)

・マルチモダリティ対応と産業別ユースケース例 (01:39:42)

・[クリエイター事例:自律走行車、音声駆動ジャケット、AIホーム警備 (01:21:04)

・[顔追跡AIで操舵・駆動を制御する乗用カープロジェクト (01:22:31)

・音声ウェイクワードで動くロボティック・フラワージャケット (01:27:28)

・[AI人間検出によるホームセキュリティの試作 (01:30:36)

・ツール貸出管理システム:RFID+顔撮影+メール送信 (01:32:34)

ChatGPT 5.2 Thinkingの回答

以下、指定タイムスタンプ部分で語られている内容を、添付アウトラインに基づいて要点説明します。

産業事例とビデオテスティモニアル:IDTのスマート治具、短期開発 (00:56:06)

- 短期開発(数か月→数日/短期間):パートナーがUno Qを受領してから、PLCとして組み込んだ製品を短期間で完成させた、という“開発サイクル短縮”の事例紹介です。短縮できた理由として、ハード/ソフトの使いやすさ、オープン設計、豊富な例、App Labの統合体験、デュアルブレインでの分担最適化が挙げられています。

- IDTのスマート治具(スマートフィクスチャ):自動車内装プラ部品の存在・位置検査を、ロボット手首のカメラで行う品質検査デモ。加えて、同一システム上で動く簡易HMIやトレーサビリティ、複数ビジョン/カメラを柔軟に扱えることが“欲しかった要件”として示され、Uno QでOSを使うことで制御・UI・ビジョン統合が狙える、という文脈です。

- 企業紹介として、IDTがオープン標準・ベンダーニュートラル志向で、Arduinoを産業用途で継続利用している点も触れられています。

クリエイター事例:自律走行車、音声駆動ジャケット、AIホーム警備 (01:21:04)

この章は、Uno QのAI推論(MPU)とリアルタイム制御(MCU)を組み合わせると、個人制作でも「AI+制御+UI」を短い期間で形にできる、という“作例まとめ”です。

顔追跡AIで操舵・駆動を制御する乗用カープロジェクト (01:22:31)

- 顔検出Brickで得たバウンディングボックスのX座標/サイズをArduinoコード側に渡し、操舵角・速度制御の入力に使う例です。

- 誤検出対策として「100px未満を無視」みたいな簡単な条件分岐を入れ、追跡を安定させています。

- 実装は、ESCをサーボライブラリで駆動し、ステアリングはポット読み取り+PIDで閉ループ制御、という構成。

AI(MPU)と制御(MCU)の分業がポイントです。

音声ウェイクワードで動くロボティック・フラワージャケット (01:27:28)

- 「Hey, Arduino」などのウェイクワード検知をトリガーに、ジャケットの“ロボ花”を動かす作品。ファッション×電子工作×音声AI×MCU制御の組み合わせ例です。

- オンデバイス推論なので、クラウド不要で展示/イベントでも動かしやすい、という利点にも触れています。

AI人間検出によるホームセキュリティの試作 (01:30:36)

- ウェブカメラ入力+人間検出モデルで、猫などを誤検知しにくくしつつ、侵入検知でブザー/アラームを鳴らす短期PoC例。

- アーム/ディスアームはWeb UIでも、物理ボタンでも操作できる構成。

- Bricks+ドラッグ構成で、PythonとArduino Cを同じ環境で扱えて「AI/UI/制御」を短時間でつなげられる、という“作りやすさ”が主旨です。

ツール貸出管理システム:RFID+顔撮影+メール送信 (01:32:34)

- RFIDで工具タグを読み、DBで入出庫管理しつつ、借用者の写真撮影→メール送信までをUno Q単体で行う、という実務寄りのプロトタイプ例です。

- 役割分担として、MCU=センサ読み取り、MPU=DB操作・画像処理・メール送信を同一基板で統合できる点が強調されています。

例示デモ:音声ウェイクワードや顔検出の応用 (01:25:04)

- 具体例として、ウェイクワードで装飾(ジャケットの花)を動かす、顔検出で車の操舵・スロットルを制御、人間検出でホーム警備(Web UI/物理ボタン操作)…が“まとめて”示されます。

- App Labの例は「Arduinoコード+Python+AIモデル」の三位一体プロジェクトとして、動かしながら調整できる点がポイントです。

実演:ステージ上での顔検出モデルの即時作成 (01:37:37)

- ステージ上で、データ収集→AI支援ラベリング→YOLO Pro Nanoで学習・評価→デバイスへ展開→ライブ検出、までを短時間で回すデモです。

- 前段として、Uno QをEdge Impulse StudioへLinux CLIで接続し、データ取得~学習~展開の一連が可能になる、という流れも示されています。

マルチモダリティ対応と産業別ユースケース例 (01:39:42)

- Wearables:オンデバイス推論でプライバシーと低遅延を両立し、健康信号検出や動作認識などに向く。

- Automotive:ビジョン/音声で、運転者の集中度監視や異常機械音の検出などをオフラインで即時に。

- Industrial:カメラや振動センサで欠陥検出・予兆検知を行い、現場条件に合わせてモデル最適化。

- いずれも「動画・音声・センサ」のマルチモダリティを、同じ“収集→学習→展開”の簡易プロセスで回して現場適応を継続改善する、という整理です。

下記の各事項に関する説明を抽出し箇条書きにしてください。

・開発期間の短縮、開発機関の短さ

・省電力、低消費電力

・ハードウェア及びソフトウェアの使いやすさ、利便性

ChatGPT 5.2 Thinkingの回答

開発期間の短縮、開発期間の短さ

- パートナーがUno Qを数週間で受け取り、PLCとして組み込んだ製品を短期間で完成させた事例が紹介されています。

- 通常数か月かかるライフサイクルを数日へ短縮できた、という説明があります。

- PC上のApp Labで「編集・実行・デバッグ」を回し、迅速な開発ループを作れるとされています。

- 初回起動でサンプルがそのまま動く「即時起動」設計により、設定の手間を減らし、教育/PoCで時間制約の中でも成果を出しやすいと説明されています。

省電力、低消費電力

- 低消費電力DSPにより、プロセッサがスリープ中でも音声処理を継続でき、常時ウェイクワード検出のような用途に適するとされています。

- 全機能を約1Wの電力枠で動かすことで、ファンレス・バッテリー駆動の設計が容易になり、電力/熱設計の制約が緩和されると説明されています。

- 低消費電力は長時間連続稼働やモバイルロボティクスに有利で、UI/映像処理/AI推論を組み合わせてもスロットリングを避けやすいとされています。

- ロボット用途で「1.2Wでファンレス運用したい」という要件がQualcomm採用理由として語られ、省電力が発熱・バッテリー稼働・筐体設計の自由度を高める価値として整理されています。

ハードウェア及びソフトウェアの使いやすさ、利便性

- 開発期間短縮の理由として、ハード・ソフト双方の使いやすさが明言されています。

- その「使いやすさ」を支える要素として、オープンな設計/豊富な例/App Labの統合体験/デュアルブレインの分担最適化が挙げられています。

- App Labがデバイスにプリインストールされ、電源投入後すぐに例を試せる「即時起動」体験が利便性として説明されています。

- Uno QにUSB-Cドングルでモニタ/キーボード/マウス/マイク/Webカメラを直結し、ボード単体で開発できる点が“現場での機動性”として語られています。

- PC資源を活用しつつ、USB-Cまたは同一ネットワーク経由でボードを操作でき、ケーブルレスな開発・検証が可能とされています。

技術的に難しく詳細不明な点もあるが、今回の調査により、低消費電力である点など、Arduino UNO Qの戦略・特徴・用途などをより深く知ることができた。

Arduino UNO Qのメリットに関するYouTube動画が多く公開されているが、サンプルプログラムを動かすまでのトラブルを報告するYouTube動画も多い。事前にセットアップ時のトラブル情報を収集しておきたい。