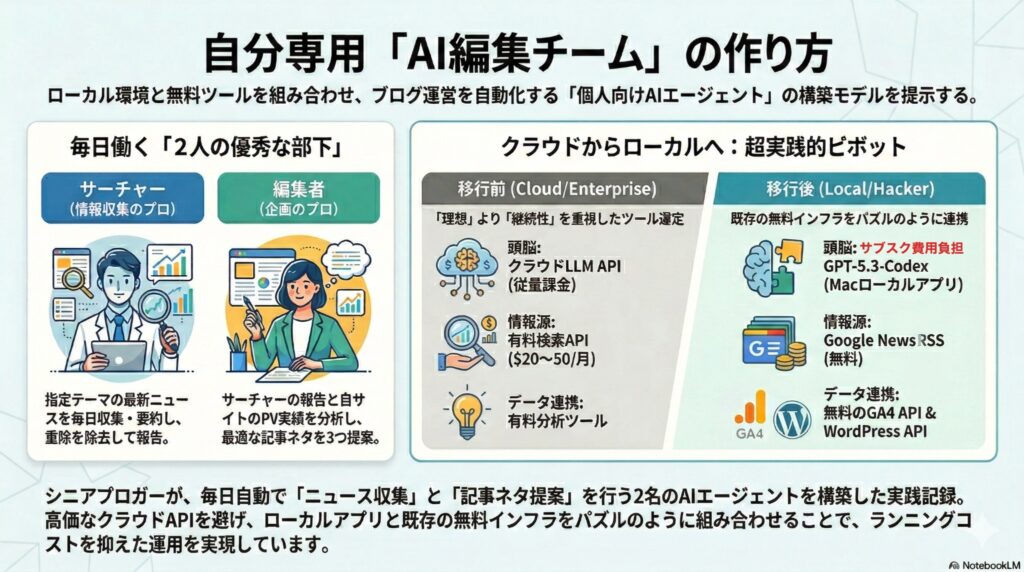

特定テーマに関するニュース配信をChatGPTのタスクとして設定し利用しているが、それらのテーマのニュースと、ブログサイトのPV上位の記事を参考にして、次のブログネタを提案してくれる仕組みを構築するために、Claude Code(Sonnet 4.6)に相談した。しかし、検討を進めていくうち、API利用料金が高くなる場合もあることが分かったので、最終的には、GPT-5.3-Codex(Mac版アプリ)を使うことにした。その経緯を紹介する。

(注)本記事の内容は正確性を保証するものではない。

(2026年2月28日 追記)YouTube動画を追加しました。 https://youtu.be/kh9E_phIYtQ

Claude Code(Sonnet 4.6) 専任AIエージェント検討

下記の2名の専任AIエージェントを設定したいので、どのように進めればいいか、アドバイスしてください。

サーチャー:

あらかじめ設定した複数テーマの最新情報を収集し重複を除去し、要約して毎日報告してくれる専任AIエージェント

編集者:

サーチャーの報告と、ユーザーのブログ記事の内容・PV数を把握し、次のブログネタを提案してくれる専任AIエージェント

Claude Codeの回答

まず、現在の環境や既存の設定を確認させてください。

現在の環境を確認しました。

では、2名のエージェントを構築するための実践的なアドバイスをお伝えします。

全体アーキテクチャ

推奨アプローチ(3段階)

Step 1: 最小構成で試す(Claude Code CLI + cron)

一番手軽に始められる方法です。

# ディレクトリ構成 ~/agents/ ├── searcher/ │ ├── CLAUDE.md # サーチャーの指示書 │ ├── topics.txt # 監視テーマ一覧 │ └── reports/ # 日次レポート保存先 ├── editor/ │ ├── CLAUDE.md # 編集者の指示書 │ ├── blog_data.json # ブログ記事・PVデータ │ └── proposals/ # テーマ提案保存先 └── run_agents.sh # 実行スクリプト

サーチャーの CLAUDE.md 例:

あなたは情報収集の専門エージェントです。 topics.txt に記載のテーマについて最新情報を収集し、 重複を除去して要約し、reports/YYYY-MM-DD.md に保存してください。

cron 設定例:

# 毎朝7時に実行 0 7 * * * /bin/bash ~/agents/run_agents.sh

Step 2: 本格構成(CrewAI フレームワーク)

エージェント間の連携を自動化するなら、CrewAI が最適です。

# crew_setup.py

from crewai import Agent, Task, Crew

from crewai_tools import SerperDevTool # Web検索ツール

searcher = Agent(

role='サーチャー',

goal='設定テーマの最新情報を収集・要約する',

tools=[SerperDevTool()],

llm='claude-sonnet-4-6'

)

editor = Agent(

role='編集者',

goal='次のブログ記事テーマを提案する',

llm='claude-sonnet-4-6'

)

Step 3: Web検索の確保(重要)

サーチャーには検索APIが必要です。

選択肢:

| ツール | 特徴 | 月額 |

|---|---|---|

| Tavily API | AI向け最適化、精度高 | 無料枠あり |

| Serper API | Google検索結果、安価 | $50〜 |

| Perplexity API | 要約込み | $20〜 |

| Claude web search | API経由で利用可 | 従量課金 |

推奨する進め方

| 週 | 内容 |

|---|---|

| Week 1 | Step 1 でMVP構築:Claude Code CLI + shell script + cron で動作確認 |

| Week 2 | データ連携:ブログのPVデータ取得方法を確定(GA4 API等) |

| Week 3 | Step 2 へ移行(必要なら):CrewAI で本格的なエージェント連携 |

次のステップを決めるために確認したいこと

- ブログのPVデータはどこから取得しますか?(Google Analytics、はてなブログ等)

- 出力形式はどうしたいですか?(メール、Slack、ファイル保存等)

- Python環境はありますか?(CrewAI を使う場合に必要)

- どちらから着手したいですか?(サーチャー先行 or 両方同時)

これらに応じて、具体的なコード実装のサポートができます。

CrewAI とは?

CrewAI は、複数のAIエージェントを協調させてタスクを自動化するための Pythonフレームワークです。

概要

複数の「エージェント」がそれぞれ役割を持ち、チーム(クルー)として連携しながら複雑なタスクを達成する仕組みを提供します。

主な概念

Agent(エージェント) 特定の役割・目標・バックストーリーを持つAIの作業単位。例えば「リサーチャー」「ライター」「アナリスト」など。

Task(タスク) 各エージェントが担当する具体的な作業。期待される出力も定義できます。

Crew(クルー) エージェントとタスクをまとめたチーム全体。どの順番・方式で実行するかを制御します。

Tool(ツール) エージェントが使える機能。Web検索、ファイル読み書き、APIコールなど。

動作の流れ

・各エージェントに役割とツールを割り当てる

・タスクを定義し、担当エージェントを指定

・Crewを実行すると、エージェントが協力してタスクをこなす

・最終的な出力が返される

特徴

ロールプレイング設計:エージェントに明確なペルソナを与えることで精度が上がる

柔軟なプロセス:Sequential(順番)やHierarchical(階層型)など実行方式を選べる

LLM非依存:OpenAI、Anthropic、Ollamaなど様々なモデルに対応

YAML設定対応:コードだけでなくYAMLでエージェント・タスクを定義可能

ユースケース例

リサーチ → 執筆 → 校正の自動化

データ収集・分析・レポート生成

コードレビューパイプライン

カスタマーサポートの自動化

LangChainと比べてエージェント間の役割分担と協調に特化しており、マルチエージェントシステムをシンプルに構築したい場合に向いています。

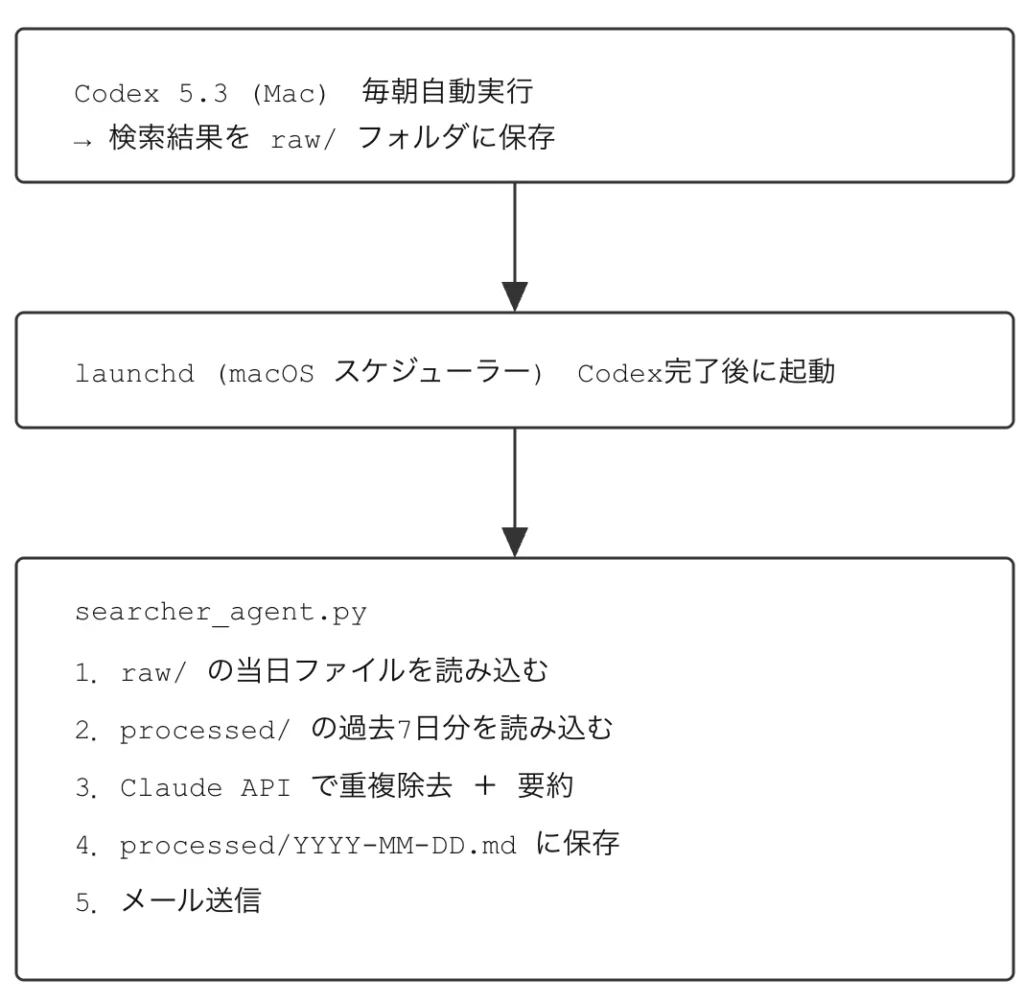

検索APIの費用が高額になる場合もあることが分かったので、検索は、Codex 5.3アプリ(Mac版)にまかせてサブスク費用内に収めることにし、その旨、Claude Codeに伝え再提案してもらうことにした。

下記の内容を加えて、再提案してください。

・検索APIの費用が高いので、検索はCodex 5.3アプリ(Mac版)に任せ、毎朝、特定のフォルダに検索結果を保存させるようにする

・サーチャーは、当日の情報同士の重複だけでなく、最近1週間の情報同士の重複も除去し、その結果を特定フォルダに保存する

・ブログのPVデータは「Google Analytics」から取得する

・出力はメールで行う

・サーチャー先行で進める

新規で作成しなければいけないフォルダがあれば指示してください

更新版アーキテクチャ(サーチャー先行)

ディレクトリ構成と作成ファイル一覧

~/agents/

│

├── config/

│ ├── topics.txt ★新規作成 監視テーマ一覧

│ └── email_config.json ★新規作成 送信先・SMTP設定

│

├── searcher/

│ ├── raw/ ★新規作成(フォルダのみ)Codex保存先

│ │ └── YYYY-MM-DD/

│ │ ├── topic_A.md ← Codex が保存するファイル

│ │ └── topic_B.md

│ │

│ ├── processed/ ★新規作成(フォルダのみ)

│ │ └── YYYY-MM-DD.md ← 重複除去済みレポート

│ │

│ └── prompts/

│ └── dedup_prompt.md ★新規作成 Claude への指示テンプレート

│

├── scripts/

│ ├── searcher_agent.py ★新規作成 メイン処理スクリプト

│ └── send_email.py ★新規作成 メール送信モジュール

│

└── ~/Library/LaunchAgents/

└── com.user.searcher.plist ★新規作成 macOS スケジューラー設定

合計:新規作成ファイル 6ファイル + 3フォルダ

各ファイルの役割と内容

config/topics.txt

Codex とサーチャー両方が参照する共通テーマ定義。

AIビジネス活用 生成AIツール最新情報 コンテンツマーケティング (以下、任意のテーマを1行ずつ)

config/email_config.json

{

"smtp_server": "smtp.gmail.com",

"smtp_port": 587,

"sender": "your-email@gmail.com",

"app_password": "xxxx xxxx xxxx xxxx",

"recipients": ["recipient@example.com"],

"subject_prefix": "[サーチャー日報]"

}

※ Gmailの場合は「アプリパスワード」を発行して使用

searcher/prompts/dedup_prompt.md

Claude への指示テンプレート(searcher_agent.py が読み込む)。

# 指示

以下の情報を処理してください。

## 当日の収集情報

{today_content}

## 過去7日間のレポート(重複確認用)

{history_content}

## タスク

1. 当日の情報同士の重複を除去する

2. 過去7日間にすでに報告済みの情報を除去する

3. 残った情報をテーマ別に整理し、各項目を3行以内で要約する

4. 重要度順に並べ替える

## 出力形式

# サーチャー日報 {date}

## [テーマ名]

- **タイトル**: 〇〇

要約: ...

出典: URL

(以下繰り返し)

scripts/searcher_agent.py(処理の流れ)

# 処理の流れのみ示します(実装時に詳細化) 1. config/email_config.json を読み込む 2. searcher/raw/今日の日付/ フォルダの全ファイルを読み込む 3. searcher/processed/ から過去7日分の .md ファイルを読み込む 4. dedup_prompt.md に 2と3 を埋め込む 5. Anthropic API (claude-sonnet-4-6) に送信 6. 結果を searcher/processed/YYYY-MM-DD.md に保存 7. send_email.py 経由でメール送信

~/Library/LaunchAgents/com.user.searcher.plist

Codex の完了後(例:7:30)に自動起動する設定。

<key>StartCalendarInterval</key> <dict> <key>Hour</key><integer>7</integer> <key>Minute</key><integer>30</integer> </dict>

実装手順(サーチャー)

- Step 1: フォルダ作成 ─

~/agents/以下のディレクトリを作成 - Step 2: Codex 5.3 の設定 ─ 保存先フォルダを

~/agents/searcher/raw/YYYY-MM-DD/に指定 - Step 3: Gmail アプリパスワード取得 ─ Googleアカウント → セキュリティ → アプリパスワード

- Step 4: 6ファイルを作成(内容は上記)

- Step 5: searcher_agent.py の実装・テスト ─ まず手動実行で動作確認

- Step 6: launchd 登録してスケジューリング有効化

確認事項

実装に進む前に確認させてください。

- Codex 5.3 が

raw/に保存するファイルの形式(.md、.txt、.json など)はわかりますか? - Python は使えますか?(

python3 --versionで確認) - Anthropic API キーはお持ちですか?

これらが確認できたら、各ファイルの実際のコードを作成します。

Anthropic APIの費用を教えてください

Anthropic API 料金表(2026年2月現在)

主要モデルの基本料金

| モデル | 入力トークン | 出力トークン | 用途 |

|---|---|---|---|

| Claude Haiku 4.5 | $1 / 100万トークン | $5 / 100万トークン | 軽量・高速タスク向け |

| Claude Sonnet 4.6 | $3 / 100万トークン | $15 / 100万トークン | 汎用・高品質 |

| Claude Opus 4.6 | $5 / 100万トークン | $25 / 100万トークン | 最高品質 |

※ 1トークン ≒ 英語4文字 / 日本語1〜2文字

サーチャーの想定コスト試算

テーマ5件・過去7日分の履歴を処理する場合の目安:

| 処理内容 | 想定トークン数 |

|---|---|

| 当日の検索結果(5テーマ × 約2KB) | 約 5,000トークン(入力) |

| 過去7日分の履歴レポート | 約 7,000トークン(入力) |

| 重複除去・要約の出力 | 約 1,500トークン(出力) |

| モデル | 1日あたり | 1ヶ月あたり |

|---|---|---|

| Haiku 4.5 | 約 $0.02 | 約 $0.50 |

| Sonnet 4.6 | 約 $0.06 | 約 $1.80 |

コスト削減オプション

| 方法 | 割引率 | 向いているケース |

|---|---|---|

| Batch API | 50%オフ | 時間指定不要な処理 |

| プロンプトキャッシュ | 最大90%オフ | 毎回同じ指示文を送る場合 |

サーチャーは毎日同じ指示文(dedup_prompt.md)を送るので、プロンプトキャッシュを使えばさらに安くなります。

まとめ

- 月額 $1〜2 程度(Sonnet 4.6 使用時)が現実的な想定コストです

- 検索API(Tavily等は月$20〜)と比べて大幅に安価

- まずは Haiku 4.5 で試して、品質が不足なら Sonnet 4.6 に切り替えるのがおすすめです

APIキーの取得は https://console.anthropic.com から無料で行えます。取得できたら、実装を開始できます。

Claudeでの処理(重複削除、要約)も想定されており、そのAPI費用が高くなる場合もあるので、Codex 5.3アプリ(Mac版)で同様の検討を行うことにした。

GPT-5.3-Codex(Mac版アプリ) 専任AIエージェント検討

下記の2名の専任AIエージェントを設定したいので、どのように進めればいいか、アドバイスしてください。

サーチャー:

あらかじめ設定した複数テーマの最新情報を収集し重複を除去し、要約して毎日報告してくれる専任AIエージェント

編集者:

サーチャーの報告と、ユーザーのブログ記事の内容・PV数を把握し、次のブログネタを提案してくれる専任AIエージェント

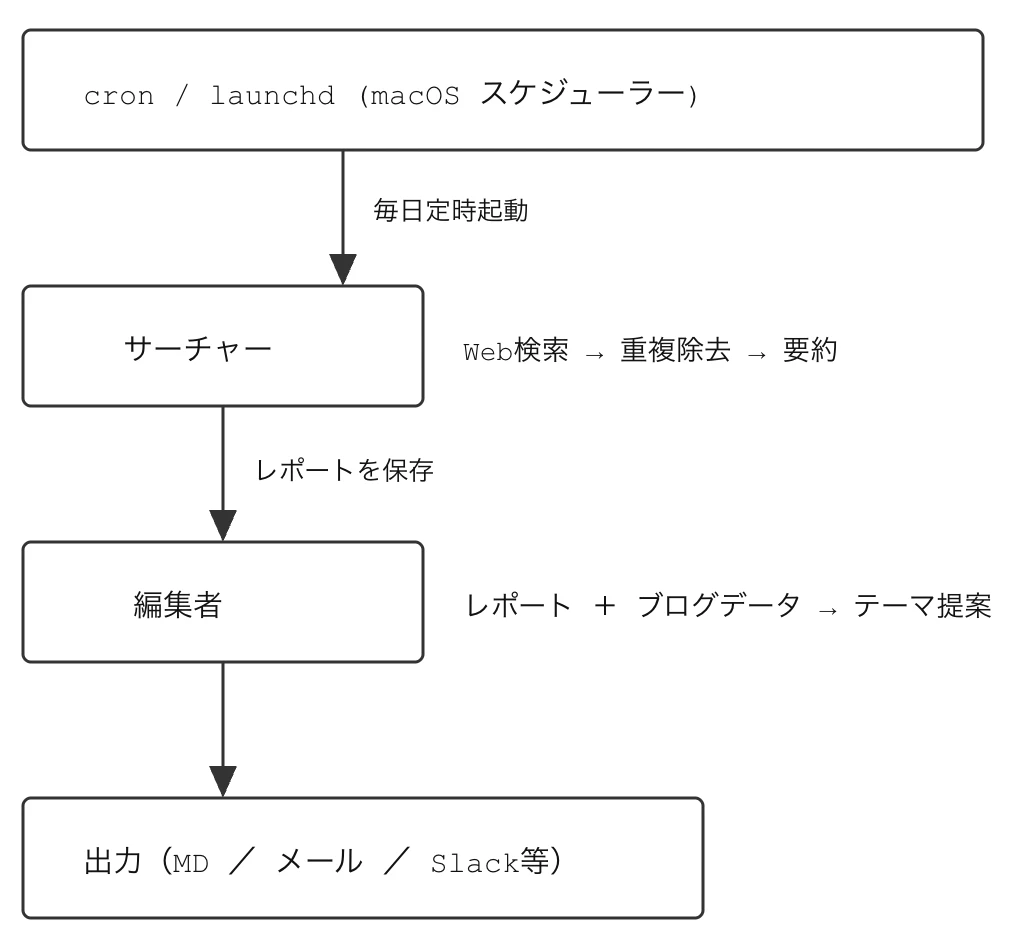

GPT-5.3-Codex(Mac版アプリ)の回答

使用スキル: skill-creator(専任エージェント化は「再利用可能な役割設計」に該当するため)

可能です。

ただし「常駐」というより、実運用は 毎日動く2つの自動化エージェント に分けるのが安定です。

- サーチャー(毎朝)

- 複数テーマ×複数ソースを巡回

- 重複除去(URL正規化 + タイトル類似度 + 本文ハッシュ)

- 要約して日次レポート出力(例:

.../reports/searcher/2026-02-22.md)

- 編集者(サーチャー後)

- 当日のサーチャー結果 + 過去記事 + PVデータを読む

- 次記事テーマを毎日提案(例: 3案、根拠、想定読者、見出し案)

進め方(最短)

- 入力データを固定

- 監視テーマ一覧

- 情報源(RSS/API/サイト)

- PVデータの取得方法(GA4 API or CSV)

- 出力フォーマットを固定

- サーチャー: 「新規性」「重要度」「要約」「出典URL」

- 編集者: 「テーマ案」「PV根拠」「狙う検索意図」「タイトル候補」

- 自動化を2本作成

- 先にサーチャー、次に編集者(30〜60分ずらし)

- 1週間で閾値調整

- 重複判定、要約粒度、提案数を調整

実装時の注意

- Web収集は取得失敗や同一記事再配信がある前提でリトライ設計にする

- 編集者の品質はPVデータの粒度(記事単位/流入クエリ単位)で大きく変わる

- まずは「提案精度」より「毎日欠かさず出る」運用安定性を優先

必要なら次のターンで、あなたの環境向けに

- サーチャー用プロンプト(重複除去ルール込み)

- 編集者用プロンプト(PV評価ロジック込み)

- 日次自動化の具体設定

まで一気に作成します。

下記の内容を加えて、再提案してください。

・サーチャーは、当日の情報同士の重複だけでなく、最近1週間の情報同士の重複も除去する。

・ブログのPVデータは「Google Analytics」から取得する。

・出力はメールで行う。

ユーザーが新規で作成しなければいけないフォルダがあれば指示してください。

GPT-5.3-Codex(Mac版アプリ)の回答

可能です。追加条件を反映すると、以下の2エージェント構成が実運用しやすいです。

再提案(要件反映版)

サーチャー(毎日朝)

- 複数テーマの最新情報を収集(RSS/API/Web)

- 重複除去を2段で実施

- 当日内重複: 同日取得データ同士を除去

- 直近7日重複: 過去1週間の既報データと照合して除去

- 日次レポートを生成し、メール送信

編集者(サーチャー完了後)

- サーチャーレポートを読み込み

- ブログ実績を

Google Analytics (GA4)から取得 - 「次に書くべき記事テーマ」を毎日提案(根拠付き)してメール送信

重複除去(1週間)実装の要点

- 記事ごとに

fingerprintを保存(例: 正規化URL + タイトル類似 + 本文ハッシュ) 直近7日の fingerprint ストアと照合して既報を除外- 保存先は

SQLiteが管理しやすいです(高速・単一ファイル)

GA取得の要点

- GA4 Data API を利用

- 必要準備:

- GA4

property_id - API利用設定(GCP)

- 認証情報(OAuthまたはサービスアカウント)

- 対象プロパティへの閲覧権限付与

メール出力

- 送信手段は

SMTP(Gmail/Workspace等)またはSendGridを推奨 - 送信内容:

- サーチャー: その日の新規要約 + 7日重複除去結果

- 編集者: テーマ案(例3件)+ PV根拠 + 想定読者 + タイトル案

ユーザーが新規作成するフォルダ

以下を作成してください(この構成で実装すると管理しやすいです)。

/Users/○○/agents/searcher/Users/○○/agents/editor/Users/○○/data/dedupe/Users/○○/data/ga/Users/○○/reports/daily/Users/○○/config

config には .env(APIキー・メール設定)を置き、data/dedupe に7日照合用DBを置く想定です。

次に進めるなら、上記フォルダ前提で「実際に動く最小構成(収集・7日重複除去・GA取得・メール送信)」をこちらで一式作成します。

ブログ実績を Google Analytics (GA4) から取得するのに費用はかかりますか

GPT-5.3-Codex(Mac版アプリ)の回答

基本的には かかりません(標準の GA4 を使う場合)。

GA4 標準プロパティは無料枠で使え、Data API もまずはクォータ管理(トークン制限)で運用します。- ただし

Google Analytics 360は有償契約です(標準と360で上限が大きく異なる)。

実務で費用が出る可能性があるのは次です。

- 360 を契約した場合(有償)

- GAデータを BigQuery に出して大量クエリする場合(BigQuery課金)

- メール送信基盤(SendGrid等)を有料プランで使う場合

- 自動実行をクラウドで回す場合(Cloud Run等の実行コスト)

2026-02-22時点の確認用公式情報:

- GA4 標準 vs 360 の上限比較(日本語): support.google.com/analytics/answer/11202874

- Analytics API の制限/クォータ: developers.google.com/analytics/devguides/limits-and-quotas

- Data API クォータ詳細: developers.google.com/analytics/devguides/reporting/data/v1/quotas

必要なら、あなたの想定アクセス量で「無料運用できるか」を試算します。

実運用を開始したのち、GPT-5.3-Codexに、現在の使用状態でGoogle Analytics (GA4) を無料枠内で使用できているかを質問した。

GPT-5.3-Codexの回答:

結論: 現在の使い方なら無料枠で十分に収まる可能性が高いです。

理由は、GA4 Data API の標準プロパティ枠が大きく、あなたの実行頻度とクエリの軽さが小さいためです。

根拠(公式上限の要点):

標準プロパティの Coreトークン上限

1日: 200,000

1時間: 40,000

プロジェクト×プロパティ×1時間: 14,000

(developers.google.com)

多くの通常クエリは 10トークン以下が目安

(developers.google.com)

現在の運用(1日1回・runReport中心)だと、消費はごく小さいはずです。

有料化が関係するのは、GA4 360へのアップグレードや大規模なクエリ乱発時です。(developers.google.com)

もし厳密に見積もりたいなら、runReport のリクエストに "returnPropertyQuota": true を入れると、実際のトークン消費が取得できます。(developers.google.com)

WordPress APIの費用を教えてください

GPT-5.3-Codex(Mac版アプリ)の回答

結論: 通常は無料です。

ただし「WordPressの種類」と「周辺サービス」で費用が変わります。

- 自己ホスト型 WordPress.org の REST API

API自体の利用料は基本ありません(WordPressはGPLで無償配布)。

かかるのは主にサーバー/ドメイン費です。 - WordPress.com REST API

Automattic公式ガイドで「API利用は無料(ただし過剰コールは不可)」と明記されています。

ただしサイト運用プラン(WordPress.comの有料プラン)や、別サービス連携は別料金になりえます。

実務で費用が出やすいのはここです。

- サーバー・ドメイン

- 有料プラグイン/テーマ

- メール配信基盤(SendGrid等)

- 実行基盤(クラウドで定期実行する場合)

参考:

- WordPress.com API利用ガイド(“Use of our API is free”)

https://developer.wordpress.com/docs/guidelines-for-responsible-use-of-automattics-apis/ - WordPress REST API Handbook(コアAPI)

https://developer.wordpress.org/rest-api/ - WordPressライセンス(GPL)

https://wordpress.org/about/license/

ユーザーが行わなければならない具体的なタスク

ここまで検討してもらった内容で、ユーザーが行わなければならない具体的なタスクを順に表にしてください。

また、このタスクまで完了したら、一旦、報告してほしい場合は、その旨の記述を表にいれてください。

費用が発生するタスクについては、概略費用の情報も入れてください。

GPT-5.3-Codex(Mac版アプリ)の回答

以下に、ここまでの検討内容を反映した「ユーザーが実施する具体タスク」を順番に整理します。

(費用は概算、税別イメージ。実際は契約プランで変動)

| No | タスク | 具体的な作業内容 | 一旦報告してほしいか | 概略費用 |

|---|---|---|---|---|

| 1 | 要件の最終確定 | 監視テーマ、配信時刻、メール送信先、提案件数 (例: 3件/日)を確定 | はい (要件確定時) | 0円 |

| 2 | フォルダ作成 | (表示省略) | はい (作成完了時) | 0円 |

| 3 | GA4の対象プロパティ確認 | 計測対象ブログのGA4プロパティIDを確定 | いいえ | 0円 |

| 4 | GA4 API有効化 | Google Cloudで Analytics Data API を有効化 | はい (有効化完了時) | 通常0円 (標準利用) |

| 5 | GA4認証設定 | サービスアカウント作成 or OAuth設定、対象GA4への閲覧権限付与 | はい (接続準備完了時) | 0円 |

| 6 | WordPress API利用確認 | WordPress REST APIで「記事一覧/本文」が取得できるか確認 (認証要否も確認) | はい (取得確認時) | 通常0円 |

| 7 | メール送信手段の決定 | SMTP(Gmail/Workspace等)か SendGrid等を選定、送信元アドレス準備 | はい(方式確定時) | 0〜数千円/月 (サービス次第) |

| 8 | 秘密情報の配置 | GA4認証情報、WP認証情報、メール設定を登録 | いいえ | 0円 |

| 9 | サーチャー仕様確定 | 収集ソース一覧、当日重複 + 直近7日重複除去ルール、出力フォーマットを確定 | はい (仕様確定時) | 0円 |

| 10 | 編集者仕様確定 | 入力(サーチャー結果 + GA4 PV + 記事本文)と提案フォーマットを確定 | はい (仕様確定時) | 0円 |

| 11 | テスト実行 (手動) | 1日分を手動で実行し、メール内容・重複除去・GA4数値の整合を確認 | はい (初回テスト結果) | 0円(実行基盤次第) |

| 12 | 定期実行設定 | 毎日「サーチャー→編集者」の順で自動化(30〜60分ずらす) | はい (自動化稼働開始時) | 0円 (ローカル運用)〜数百〜数千円/月(クラウド) |

| 13 | 1週間チューニング | 重複閾値、要約粒度、テーマ提案精度を調整 | はい (1週間レビュー時) | 0円 |

費用が発生しやすいポイント(要注意)

メール配信:大量送信や到達率要件があると有料化しやすいクラウド実行:Cloud Run等に載せると利用量に応じて課金GA4:標準運用は通常無料だが、360契約は有償

必要なら次に、この表をそのまま実行管理できるように「チェックリスト版(担当・期限・完了条件付き)」に変換します。

「チェックリスト版(担当・期限・完了条件付き)」の形式でも出力してください

GPT-5.3-Codex(Mac版アプリ)の回答

以下、チェックリスト版(担当・期限・完了条件付き)です。

(基準日: 2026-02-22、期限は推奨)

| チェック | タスク | 期限 (推奨) | 完了条件 | 報告タイミング |

|---|---|---|---|---|

| ☐ | 要件の最終確定 | 2026-02-23 | 監視テーマ、配信時刻、送信先、提案件数が文書化されている | 完了時に報告 |

| ☐ | フォルダ作成 | 2026-02-23 | 指定6フォルダが作成済み | 完了時に報告 |

| ☐ | GA4対象プロパティ確認 | 2026-02-24 | property_id が確定している | 任意 |

| ☐ | GA4 API有効化 | 2026-02-24 | Google Cloudで Analytics Data API が有効 | 完了時に報告 |

| ☐ | GA4認証設定 | 2026-02-24 | サービスアカウント/OAuth設定完了、GA4閲覧権限付与済み | 完了時に報告 |

| ☐ | WordPress API利用確認 | 2026-02-25 | 記事一覧・本文取得の疎通確認済み(認証要否も確定) | 完了時に報告 |

| ☐ | メール送信手段の決定 | 2026-02-25 | SMTP or SendGrid等が確定し送信元アドレス準備済み | 完了時に報告 |

| ☐ | 秘密情報の配置 | 2026-02-25 | 必要値を登録 | 任意 |

| ☐ | サーチャー仕様確定 | 2026-02-26 | 当日重複+7日重複の除去ルール、出力項目が確定 | 完了時に報告 |

| ☐ | 編集者仕様確定 | 2026-02-26 | 入力(サーチャー+GA4+本文)と提案フォーマットが確定 | 完了時に報告 |

| ☐ | 手動テスト実行 | 2026-02-27 | 1日分の処理でメール受信、数値整合、重複除去が確認済み | 完了時に報告 |

| ☐ | 定期実行設定 | 2026-02-28 | 毎日「サーチャー→編集者」が自動実行(30〜60分差) | 完了時に報告 |

| ☐ | 1週間チューニング | 2026-03-07 | 閾値・要約粒度・提案品質の調整結果が反映済み | 完了時に報告 |

必要ならこのまま使えるように、次は「進捗管理用Markdown(status / owner / due / notes付き)」を作ります。

要件の最終確定は下記の通りです。

監視テーマ:AI,CarPlay,Android Auto,Arduino

配信時刻:毎日朝8時

メール配信先:**********@******

提案件数:3件/日

GPT-5.3-Codex(Mac版アプリ)の回答

要件を反映しました。No.1 要件の最終確定 は完了です。

確定内容:

- 監視テーマ:

AI,CarPlay,Android Auto,Arduino - 配信時刻: 毎日

08:00 - メール配信先: **********@******

- 提案件数:

3件/日

次のタスク(No.2)として、以下を作成してください。

(フォルダ名表示省略)

作成が終わったら、No.2完了として報告してください。

「No.2完了」と報告し、その後のタスクを進めた。No.3以降のGPT-5.3-Codexの回答を紹介する。

| タスク No | GPT-5.3-Codexの回答 |

| 3 | 確認しました。No.2 フォルダ作成 完了です。次は No.3 GA4の対象プロパティ確認 です。以下を確認して、 GA4 property_id を共有してください。Google Analytics にログイン 対象プロパティを開く 管理 → プロパティ設定 で プロパティID を確認共有後、 No.4 GA4 API有効化 に進みます。 |

| 4 | 確認しました。No.3 GA4の対象プロパティ確認 完了です。property_id: **********で進めます。 次は No.4 GA4 API有効化 です。実施手順: Google Cloud Console を開く GA4連携用のプロジェクトを選択(なければ新規作成) APIとサービス → ライブラリGoogle Analytics Data API を検索有効にする をクリック完了したら、 No.4完了 と報告してください。 |

| 5〜9 | (表示省略) |

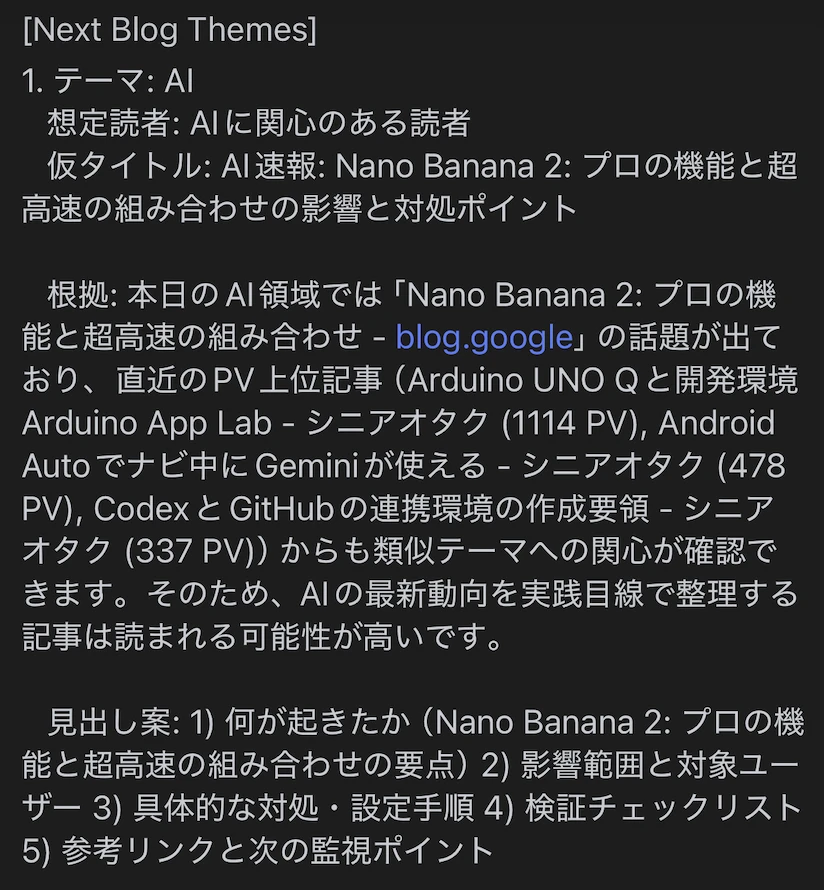

| 10 | No.9 サーチャー仕様確定 完了を確認しました。 次は No.10 編集者仕様確定 です。以下内容で確定してください。入力データ: 当日のサーチャーレポート WordPress記事本文( roompine.com)GA4 PVデータ(property_id: ***********) 分析方針: 直近PV上位記事の共通点を抽出 サーチャー新着トピックとの掛け合わせで機会領域を選定 既存記事との重複テーマを避ける 出力(毎日3件): テーマ案 根拠(トレンド + PV) 想定読者 仮タイトル 見出し案(3〜5個) 配信: 毎日メール(サーチャー後に送信) 宛先 ***********@****** これでよければ No.10完了 と返信してください。 |

| 11 | No.10 編集者仕様確定 完了を確認しました。 次は No.11 テスト実行(手動) です。実行時の確認観点はこの3点です。 サーチャー結果メール 4テーマ分が取得されている 当日重複と7日重複が除去されている URLと要約が読める形で出ている 編集者結果メール 3件のテーマ提案がある 各提案にPV根拠とトレンド根拠がある 既存記事との重複回避ができている 数値整合 メール記載PVとGA4確認値に大きなズレがない 完了したら No.11完了 と結果(問題あり/なし)を報告してください。問題があれば、その内容に合わせて調整項目を具体化します。 実施後に以下の形式で報告してください。 No.11完了結果: 問題なし または 結果: 問題あり問題ありの場合は、1行ずつ具体的に記載 例: 「サーチャーメール未着」 例: 「GA4のPVが0件になる」 例: 「提案が3件出ない(2件のみ)」 この報告を受けたら、次の修正手順または No.12 への進め方を具体化します。 |

| 12 | No.11 テスト実行(手動) 完了を確認しました。結果 問題なし で記録します。次は No.12 定期実行設定 です。毎日8:00運用にするため、以下の2本を自動化します。 08:00 searcher 実行08:30 editor 実行必要であれば、このまま launchd 用の設定ファイル作成手順(Mac標準)を具体的に出します。 (launchd 用の設定ファイル作成を指示) 半自動設定を完了しました。 launchd に登録済みです。実施内容: 定期実行設定ファイルを作成 インストールスクリプトを作成して実行 ○○フォルダに配置・有効化 com.○○.searcher.daily(毎日 08:00)com.○○.editor.daily(毎日 08:30)現在状態: 両ジョブとも state = not running(待機中)これは正常で、次の実行時刻に自動起動します。 ログ出力先: /logs/searcher.out.log/logs/searcher.err.log/logs/editor.out.log/logs/editor.err.logこの内容で No.12完了 として進めて問題ありません。 |

| 13 | No.12 定期実行設定 完了を確認しました。 残りは No.13 1週間チューニング です。 2026-03-07 を目安に、以下を確認して調整してください。 重複除去: 誤除外/取りこぼしがないか サーチャー要約: 長さ・読みやすさ 編集者提案: 3件の妥当性、PV根拠の納得感 配信品質: 未着や遅延がないか(ログ確認) 1週間後に結果を No.13完了 / 結果: 問題なし or 問題ありの形式で報告してください。 |

チェックリストに従って特に問題なくタスクを手動で処理できた。AIにブラウザを操作させるようなことは行なっておらず、設定しないといけない項目が多いので、指示内容通りに進められるか不安だったが、設定画面のメニュー名が指示内容と違っているというようなこともなく、スムーズに作業を進めることができた。指示内容が正確である。

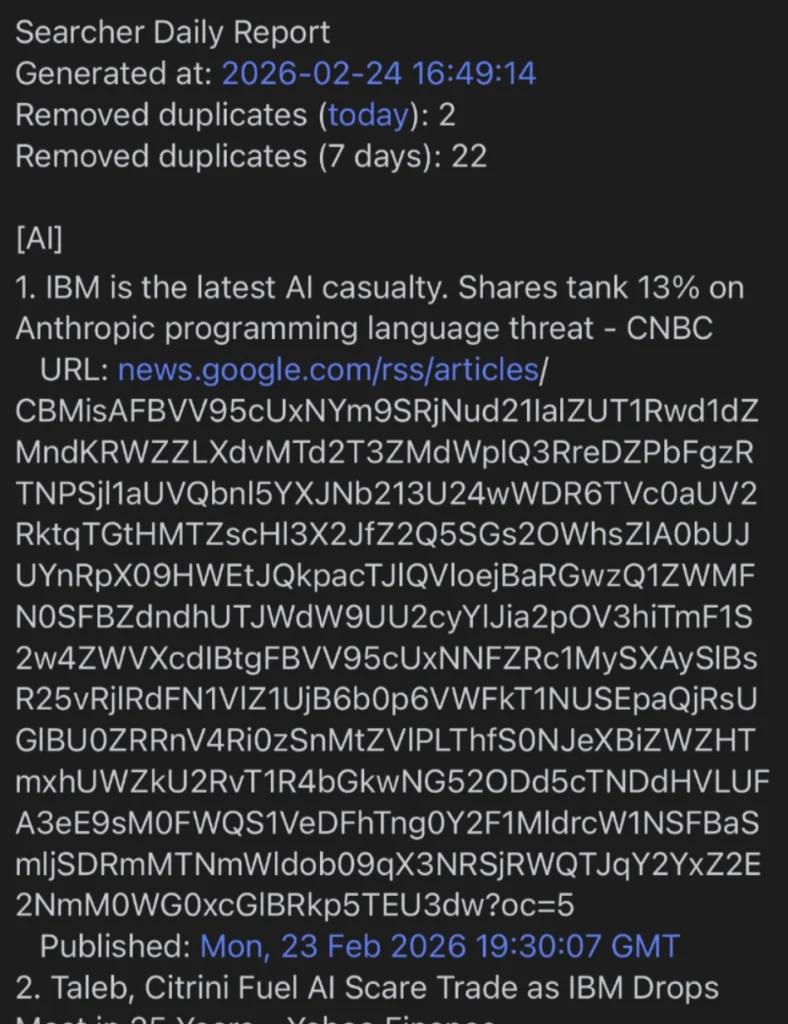

メール配信情報のチューニング

実際に配信されたメールでは、非常に長いリンクが表示されていたり、リンクが切れていたり、日本語表示がない部分があったりと、色々と修正をお願いすることになった。

また、ブログネタを決める際に、ニュース記事のほかに、PV上位のブログ記事の内容を参考にしてもらうわけだが、WordPressとの通信量が増えるのでブログ記事のタイトルと冒頭の段落だけを使うように指示した。

提案内容に関する考察・工夫が足りておらず、ニュース記事を解説するような内容になっているなどの点で、チューニングが必要だか、これらの条件を容易に日本語で変更することができる。

(リンクが長い、重複除去されている、日本語翻訳がない)

追加調査

情報調査の情報源はどのように設定していますか。情報源の設定方針・設定根拠を教えてください

GPT-5.3-Codex(Mac版アプリ)の回答

現状の情報源は Google News のRSS だけです。

設定は searcher に固定値で入っています。

- 参照URL:

https://news.google.com/rss/search?q={query}&hl=en-US&gl=US&ceid=US:en - 検索語:

AI,CarPlay,Android Auto,Arduino

設定方針

- まずは1ソースで広く拾い、重複排除と要約で整理する

- 日次運用の安定性を優先(RSSは壊れにくい)

設定根拠

- 初期は工数を増やさず、漏れと重複を見てからソースを追加するのが安全

- Google Newsは速報性とカバレッジが広く、初期の探索に向く

もし方針を変えるなら、以下を追加できます。

- 複数RSSの併用(公式ブログ、業界メディア、メーカー公式)

- 特定サイトのみ(信頼性優先)

- 日本語ソース優先(

hl=ja&gl=JPに変更)

要望があれば、ソース追加と優先順位付けを実装します。

サーチャーと編集者が、現状、どのように設定されているかを表示してください

GPT-5.3-Codex(Mac版アプリ)の回答

現状設定の要点は以下です。

サーチャー

- 実行:

/Users/○○/agents/searcher/run_searcher.py - 監視テーマ:

AI,CarPlay,Android Auto,Arduino - 取得元: Google News RSS

https://news.google.com/rss/search?q={query}&hl=en-US&gl=US&ceid=US:en - 取得件数: 1テーマあたり最大15件、出力は最大5件

- 重複除去: 当日重複+過去7日重複(SQLite:

/Users/)○○/data/dedupe/searcher.sqlite3 - タイトル: 英語原題を日本語に翻訳して併記

- URL: Google News中継リンクは可読な説明文に置換

- 出力:

/Users/○○/reports/daily/searcher-YYYY-MM-DD.txt - メール送信:

MAIL_FROM→MAIL_TO○○

編集者

- 実行:

/Users/○○/agents/editor/run_editor.py - テーマ:

AI,CarPlay,Android Auto,Arduino - 提案数: 3件

- 参照:

- GA4(過去28日、PV上位10件)

- WordPress

https://roompine.com/○○ - サーチャーレポート(当日ファイルが無い場合は最新を使用)

- 出力:

/Users/○○/reports/daily/editor-YYYY-MM-DD.txt - メール送信:

MAIL_FROM→MAIL_TO○○

定期実行(launchd)

- サーチャー: 毎日 08:00

/Users/○○/config/launchd/○○ - 編集者: 毎日 08:30

/Users/○○/config/launchd/○○ - ログ:

/Users/○○/reports/daily/logs/searcher.out.log/Users/○○/reports/daily/logs/searcher.err.log/Users/○○/reports/daily/logs/editor.out.log/Users/○○/reports/daily/logs/editor.err.log

メール設定(表示省略)

このプロジェクトでは、2名の専任AIエージェントを常駐させたいということで相談しましたが、そもそも、このプロジェクトでは、2名の専任AIエージェントを設定する必要はなく、1名のAIエージェントが、サーチャーと編集者の役割の両方を行うとすればよかったのですが、2名設定するメリットはありますか。

GPT-5.3-Codex(Mac版アプリ)の回答

はい、このプロジェクトなら1名に統合でも成立します。

同時実行しない前提なら、むしろ1名のほうが運用は簡単です。

2名分離のメリット:

- 役割が明確

- 切り分けしやすい

- 将来、実行時刻や担当を分けやすい

1名統合のメリット:

- 設定・監視が簡単

- 障害点が減る

- スケジュール管理が1本で済む

この案件の実態(毎日1回、順番処理)だと、1名統合が合理的です。

処理は1ジョブ内で サーチャー処理 → 編集者処理 → メール2通送信 にすれば十分です。

必要なら次で、現在の構成を崩さずに

- 1本化スクリプト作成

launchdも1ジョブへ統合

までこちらで実施します。

今回のプロジェクトの場合、AIエージェントは1名でよかったが、エージェントを分けておいた方が、将来、機能拡張しやすいのではないかと思う。例えば、調査を行うサーチャーとは別に、ファクトチェックを行うAIエージェントを設けたり、編集者に、作成したブログ記事ネタに関する追加調査をサーチャーに指示する機能を追加したりする場合など、今後、AIエージェントが同時に働き、情報交換するような改良を行っていきたい。

また、情報源設定方針の改良のほか、いままで扱ったことのない分野のブログ記事提案などの機能追加を検討する。