下記の記事で、「Siriの基盤がGeminiカスタムモデルになった」というような将来起こりうる事象を検知するためのGPTを作成したことを報告したが、検知する事象の追加をChatGPT 5.5 Thinkingに依頼したところ、GPTの「指示」欄に入力する指示内容は作成できたのだが、その欄に入力できるのは8000文字以内という制限に引っかかって指示内容を更新することができなかった。これまで、GPTを作成したことはあったが、2度と使わなかったり、作成したことさえ忘れている程度のものしか作成していなかったのでこの制限には驚いた。

そこで、GPTと同様の機能について、複数のAIに比較調査を行ってもらった。具体的には、ChatGPT 5.5 Thinking、Gemini 3(思考モード)、Opus 4.7 Adaptive Thinkingに比較調査を依頼した。

また、ブログ記事としてまとめるための提案をしてもらったので紹介する。

(注)本記事の内容は正確性を保証するものではない。

(2026年4月26日 追記)YouTube動画を追加しました。 https://youtu.be/6OVLTDjF6Lg

GPT相当機能比較(ChatGPT 5.5 Thinking 回答)

最近、ChatGPTのGPTを作成したのですが、GPTの「指示」の欄に入力できる文字は8000文字以内という理由で、その指示内容を保存(更新)できないことがありました。そこで、各AIの、GPTと同様の機能(GeminiではカスタムGemと思われる)の比較をブログ記事にしてはどうかと思います。各AIの最新の情報を調査して、その比較を行ってください。また、調査内容について何か有用な調査内容があれば提案してください

調査日:2026年4月25日

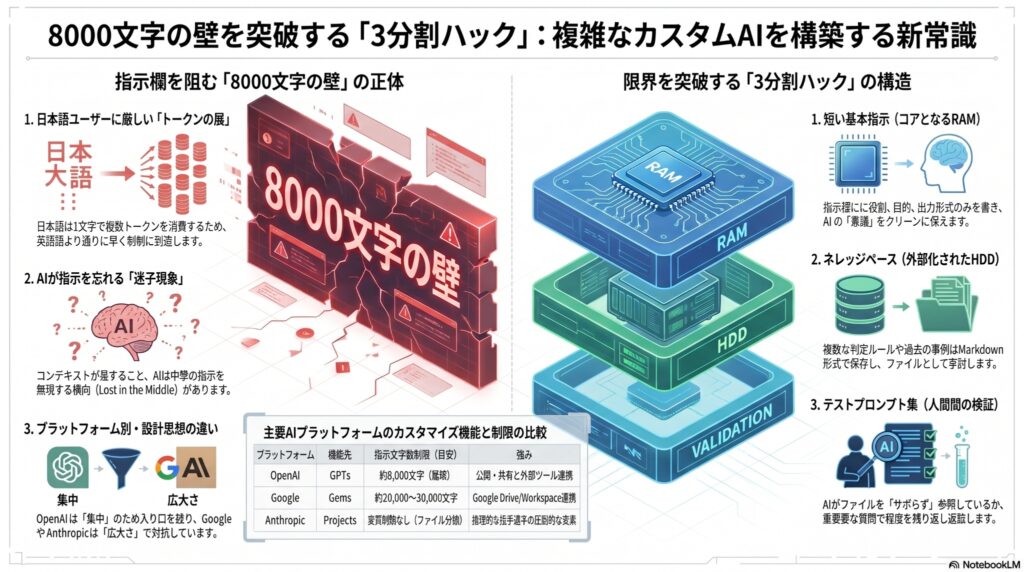

結論として、このテーマはブログ記事に向いています。特に「GPTの指示欄に長文を入れすぎると保存できない」という実体験を入口にして、各AIの“カスタムAI機能”は、同じように見えて設計思想がかなり違うという切り口にすると読みやすいです。

なお、ChatGPTのGPTにおける「8,000文字制限」は、今回確認したOpenAI公式ヘルプ上では明確な仕様値としては見つかりませんでした。一方、OpenAIコミュニティ等では同様に「8,000 characters」を超えると保存できないという報告があります。記事では「公式仕様」と断定せず、筆者環境で確認した実用上の制約として扱うのが安全です。(OpenAI Help Center)

主要AIの「GPT相当機能」比較(抜粋)

| AI / サービス | GPT相当の機能名 | 位置づけ | 強み | 注意点 |

|---|---|---|---|---|

| ChatGPT | GPTs | もっとも「カスタムGPT」そのものに近い | 指示、会話スターター、Knowledge、 Web検索、画像生成、Canvas、コード実行、Apps / Actionsを組み合わせられる。 Knowledgeは最大20ファイル、各512MBまで。 共有は非公開、特定ユーザー、ワークスペース、リンク共有、GPT Store公開などが可能。(OpenAI Help Center) | GPTは保存済みメモリ、カスタム指示、過去会話を利用しない。 AppsとActionsは同時利用できない。 長い指示はInstruction欄に詰め込みすぎず、Knowledgeや外部ドキュメントに分ける必要がある。(OpenAI Help Center) |

| Google Gemini | Gems | Gemini版カスタムGPT | 名前、指示、Knowledgeファイルを設定して専用Gemを作れる。 Google Drive上のファイルをKnowledgeにすると、Drive側の最新内容が反映される。 NotebookLMノートブックも追加可能。(Google ヘルプ) | Gemini LiveではGemsを使えない。 作成は主にWebアプリ側。 ファイル添付やコンテキスト上限はプラン・機能により差がある。(Google ヘルプ) |

| Gemini / NotebookLM | Gemini Notebooks / NotebookLM | GPTというより「調査ノート型AI」 | Gemini Notebooksは、チャット、ファイル、カスタム指示をまとめ、NotebookLMと同期できる。 NotebookLMは無料版でも最大100ノートブック、各50ソース、各ソース最大50万語または200MBまで扱える。(blog.google) | 公開用の“カスタムAI”というより、資料ベースの調査・要約・学習向け。 Google Driveから取り込んだソースはNotebookLM内では静的コピーで、変更時は手動同期が必要。(Google ヘルプ) |

| Claude | Projects / Skills | 長文業務・反復作業に強い | Projectsはプロジェクト単位で指示とKnowledgeを持てる。 Claude Skillsは、指示・スクリプト・リソースをフォルダ化して必要時に読み込む仕組みで、複雑な作業手順の再利用に向く。(Claudeヘルプセンター) | GPT Storeのような一般公開型ではなく、個人・チーム内の作業基盤寄り。 Skillsはコード実行や外部取得を伴う場合があるため、信頼できないSkillの利用には注意が必要。(Claudeヘルプセンター) |

| Microsoft 365 Copilot | Copilot Agents / Agent Builder / SharePoint agents | 企業内ナレッジ向けエージェント | Agent Builderでノーコード作成でき、SharePoint、Teams、Outlook、公開Webサイト、コネクタ等をKnowledgeとして使える。 Microsoft 365内での業務利用に強い。(Microsoft サポート) | 個人ブロガー向けの簡単なGPT代替というより、Microsoft 365環境・組織管理・ライセンス前提の機能。 課金や管理者設定が比較的複雑。(Microsoft Learn) |

| Perplexity | Spaces | 調査ワークスペース型 | SpaceごとにカスタムAI指示、ファイル検索、Web・論文・SNS等の検索ソース、Computer tasksをまとめられる。 最新情報の調査や定期調査の土台に向く。(Perplexity AI) | GPTのような公開ボットというより、調査プロジェクト用スペース。ファイル数はプランにより、Proは50ファイル、MaxやEnterpriseではより大きい上限になる。(Perplexity AI) |

ブログ記事タイトル案

一番おすすめは次です。

GPTの8,000文字制限で困った人へ:ChatGPT・Gemini・Claude・CopilotのカスタムAI機能を比較

ほかには、以下も使えます。

- カスタムGPTの代替はどれ?Gemini Gems・Claude Projects・Copilot Agentsを比較

- 長い指示をAIに覚えさせる方法:GPTs、Gems、Projects、Spacesの違い

- “自分専用AI”を作るならどれ?主要AIのカスタム機能比較 2026年版

ブログ記事タイトル案として提案されている各項目について下記のように対応する。

・カスタムGPTの代替はどれ?

→Gemini GemsとClaude Projectsに指示内容を入力して、今後、それらの実行結果を確認して判断する。

実際、今はGPTに入らなかった指示内容を入れたGemを作成済み。

・長い指示をAIに覚えさせる方法

→この方法が必要になるのはGPTだけのようなので本調査で分かった対策の効果を今後検証する。

・主要AIのカスタム機能比較 2026年版

→本記事のテーマは「指示内容の文字制限」であるが、この機能比較はもっと広い範囲の調査が必要となるので

本記事では扱わない。

記事構成案(抜粋)

なぜGPTの指示欄に長文を入れすぎると困るのか

ここでは、今回の実体験を導入に使います。

「監視条件」「判定基準」「出力形式」「禁止事項」「参考例」などをすべて指示欄に入れると、保存上限だけでなく、AI側の解釈も不安定になりやすい。

そこで、指示欄には短いルール、Knowledgeには詳細資料、テスト用プロンプトには検証条件を置く、という分割設計が必要になる、という流れが自然です。

ChatGPT GPTsとGemini Gemsの違い

ここは読者の関心が高いと思います。

ChatGPT GPTsは「公開・共有・ツール連携」に強く、Gemini Gemsは「Google DriveやNotebookLMとの連携」に強い、という整理が分かりやすいです。

結論:用途別おすすめ

- 公開・共有したい:ChatGPT GPTs

- Google Drive資料を使いたい:Gemini Gems

- 長文資料をもとに調査したい:NotebookLM、Gemini Notebooks

- 複雑な業務手順を再利用したい:Claude Projects / Skills

- 最新Web調査を継続したい:Perplexity Spaces

- Microsoft 365内の社内業務で使いたい:Copilot Agents

追加で調査すると有用な内容

この記事を強くするなら、公式仕様の比較だけでなく、実機テストを入れるとかなり価値が出ます。

特におすすめの検証項目は次です。

| 検証項目 | 調べる価値 |

|---|---|

| 指示欄に何文字まで保存できるか | 公式に書かれていない場合が多く、実体験記事として価値が高い |

| 長文指示を入れたときの遵守率 | 「保存できる」と「正しく動く」は別問題 |

| Knowledgeに入れた内容をどの程度参照するか | 指示欄とKnowledge欄の役割分担を説明できる |

| ファイル更新が反映されるか | Gemini Drive連携、NotebookLM、GPT Knowledgeなどで差が出る |

| 日本語の指示遵守 | 日本語ブログ読者には重要 |

| 共有時に何が見えるか | 指示、ファイル、会話履歴、権限の違いは重要 |

| 無料・有料プラン差 | 読者の導入判断に直結する |

| Web検索との相性 | 監視GPTやニュース調査用途では重要 |

| 外部ツール連携 | GPT Actions、Claude Skills、Copilot Agentsなどの差が出る |

記事内で特に強調したい実用ポイント

長い指示を1つの欄に詰め込むより、次の3分割にした方が安定します。

| 分け方 | 入れる内容 |

|---|---|

| 短い基本指示 | 役割、目的、出力形式、禁止事項、判定基準の要約 |

| Knowledge / ファイル | 詳細ルール、過去の出力例、参照資料、長い条件一覧 |

| テストプロンプト集 | 正しく動くか確認するための質問例、失敗例、期待出力 |

下記の回答のように回答されましたが、それによれば、下記の修正版GPT指示内容は、どのように3つに分割されますか。3つに分けてください。

##回答 長い指示を1つの欄に詰め込むより、次の3分割にした方が安定します。

分け方 (入れる内容)

・ 短い基本指示(役割、目的、出力形式、禁止事項、判定基準の要約)

・Knowledge / ファイル(詳細ルール、過去の出力例、参照資料、長い条件一覧)

・テストプロンプト集(正しく動くか確認するための質問例、失敗例、期待出力)

## 修正版GPT指示内容

(ChatGPT 5.5 Thinkingが作成した修正版の内容、表示省略)

はい。下記のように分けるのがよいです。

1:GPTの「指示」欄に入れる短い基本指示

2:Knowledge / ファイルとして入れる詳細ルール

3:動作確認用のテストプロンプト集

- GPTの「指示」欄に入れる短い基本指示

これはGPT作成画面の「指示」欄に貼る本文です。

できるだけ短くし、詳細ルールはKnowledge側に逃がします。

あなたは、5つの技術条件をWeb調査し、「新規に確認されたものだけ」を報告する監視アシスタントです。

毎回、必ず最新のWeb検索を行い、Knowledgeに登録された監視ルール・判定基準・出力形式に従って調査してください。

目的:

5つの監視条件について、「現在使える / 正式サポート / 一般提供」と判断できる新規事象だけを抽出してください。

最重要方針:

- 必ずWeb検索を使う

- 単純なキーワード一致で判定しない

- official と major_media を明確に区別する

- planned / rumor / preview / beta は検知対象にしない

- 地域やプラットフォームが必要な条件は、条件と一致しない限り採用しない

- 強い反証がある場合は「保留」とする

- 情報が曖昧な場合は断定しない

- URLは必ず示す

- 今日時点の確認結果として完結に書く

採用方針:

- 条件2は official のみ採用可

- 条件1, 3, 4, 5 は official が1本あれば採用候補

- official がない場合は major_media 2本以上で採用候補

- blog / unknown は補助的参考にとどめ、単独では採用しない

- 反証を打ち消せない場合は「保留」とする

出力は必ず次の3部構成にしてください。

### 1. 新規検知

新規に確認された条件だけを列挙する。

新規検知が1件もない場合は、先頭に「本日、新規検知はありません。」と明記する。

### 2. 条件別判定一覧

5条件すべてについて、条件ID・判定・短い理由を示す。

### 3. 判断メモ

曖昧だった点、保留理由、追加確認が必要な点を箇条書きで整理する。

文体:

- 日本語で簡潔明瞭に書く

- 調査結果と推測を混同しない

- 曖昧な点は「〜と読める」「〜の可能性」「断定不可」と表現する

- 誇張しない

- 余計な前置きは不要- Knowledge / ファイルに入れる詳細ルール

これは、GPTのKnowledgeに入れるファイルです。

ファイル名は、たとえば次のようにします。

technical_event_monitoring_rules.md

内容は下記です。

# 技術条件監視ルール

## 1. 監視対象

以下の5条件について、毎回最新のWeb検索を行い、「現在使える / 正式サポート / 一般提供」と判断できる新規事象だけを抽出する。

### 条件1

ClaudeAIが外部SSDにアクセスできるようになった

### 条件2

SiriのファウンデーションモデルがGeminiカスタムモデルになった

### 条件3

日本で、CarPlayにGeminiカスタムモデルが使えるようになった

### 条件4

日本で、Android AutoでGeminiカスタムモデルが使えるようになった

### 条件5

Google MapsでGeminiが使えるようになった

---

## 2. ソース分類ルール

各記事ソースを以下のいずれかに分類する。

### official

企業公式サイト、公式ブログ、公式ヘルプ、公式ドキュメント、公式発表。

例:

- OpenAI公式

- Anthropic公式

- Apple公式

- Google公式

- Microsoft公式

- 公式サポートページ

- 公式開発者ドキュメント

### major_media

一般に広く認知された大手報道機関・大手技術メディア。

例:

- The Verge

- 9to5Google

- 9to5Mac

- MacRumors

- TechCrunch

- Bloomberg

- Reuters

- CNET

- Android Authority

- Android Police

### blog

個人ブログ、企業ブログでも公式発表ではない解説記事、レビュー記事、考察記事。

### unknown

上記のいずれとも断定しにくい情報源。

---

## 3. 採用ルール

### 条件2

条件2「SiriのファウンデーションモデルがGeminiカスタムモデルになった」は、official のみ採用可。

major_media、blog、unknown のみでは検知にしない。

### 条件1, 3, 4, 5

条件1, 3, 4, 5 は、official が1本あれば採用候補とする。

official がない場合は、major_media 2本以上で採用候補とする。

blog / unknown は補助的参考にとどめ、単独では採用しない。

### 反証がある場合

強い反証がある場合は採用せず、「保留」とする。

---

## 4. 検索手順

各条件ごとに必ず次を行う。

1. 複数の検索クエリで候補記事を集める

2. 重複URLや同一内容を除く

3. 各記事について次の点を確認する

- 主体が一致しているか

- 機能が一致しているか

- 地域が一致しているか

- プラットフォームが一致しているか

- 現在利用可能か

- planned / rumor / preview / beta ではないか

- 反証があるか

4. 条件ごとに最終判定する

5. 新規に確認されたものだけを報告する

---

## 5. 基準検索クエリ

### 条件1

- Claude external SSD support official

- Claude can access external drive official

- Anthropic Claude external storage support

### 条件2

- Apple Siri Gemini custom model official

- Siri foundation model Gemini official

- Apple Siri Gemini partnership official

### 条件3

- CarPlay Gemini custom model Japan official

- Japan CarPlay Gemini availability official

- Google Gemini CarPlay Japan supported

### 条件4

- Android Auto Gemini custom model Japan official

- Japan Android Auto Gemini availability official

- Google Gemini Android Auto Japan supported

- Gemini for Android Auto Japan official

- Android Auto Gemini Japan rollout official

### 条件5

- Google Maps Gemini official

- Gemini in Google Maps official

- Google Maps powered by Gemini official

---

## 6. 記事ごとの確認用データ項目

候補記事を精査する際、内部的に次の項目を確認する。

- condition_id

- article_url

- source_type

- subject_match

- feature_match

- region_match

- region_values

- platform_match

- platform_values

- availability_stage

- is_currently_available

- is_only_planned

- is_only_rumor

- evidence

- contra_evidence

- decision_hint

- reason_short

---

## 7. 判定ルール

### 検知

現時点で利用可能 / 正式サポート / 一般提供と判断でき、新規に確認されたもの。

### 保留

有力だが、次のいずれかが曖昧なもの。

- 地域

- 提供段階

- 対象機能

- 公式性

- 反証の有無

- 対応プラットフォーム

- 実際に現在利用可能かどうか

### 非該当

次のいずれかに該当するもの。

- 条件不一致

- 予定のみ

- 噂のみ

- preview / beta のみ

- 地域不一致

- プラットフォーム不一致

- 対象機能が違う

- 公式または十分なmajor_media根拠がない

---

## 8. 「新規」の扱い

- その回の調査で、新たに条件充足を確認できたものだけを「新規検知」に載せる

- それ以外の条件も、条件別判定一覧には必ず載せる

- 過去の会話文脈に依存せず、その回の調査結果として完結に示す

- 以前から知られている話でも、今回の調査で正式確認できたなら、その回の結果として扱ってよい

- ただし、予定情報から正式提供に変わったのか、単なる再報なのかが曖昧なら保留寄りにする

---

## 9. 反証の扱い

- 公式ヘルプや公式FAQ、公式仕様で明確に未対応・対象外と読める場合は強い反証として扱う

- major_media 同士で食い違う場合は、より新しい日付と一次情報に近いものを優先する

- official と major_media が矛盾したら official を優先する

- 反証を打ち消せない場合は「保留」にする

---

## 10. 出力形式の詳細

出力は必ず次の3部構成にする。

### 1. 新規検知

新規に確認された条件だけを列挙する。

各項目に以下を含める。

- 条件名

- 判定: 検知 / 保留 / 非該当

- 要約

- 通知理由

- 根拠URL

- 反証要点

- source_type の内訳

新規検知が1件もない場合は、先頭に次の文を明記する。

本日、新規検知はありません。

### 2. 条件別判定一覧

5条件すべてについて以下を簡潔に示す。

- 条件ID

- 判定

- 短い理由

### 3. 判断メモ

以下を箇条書きで整理する。

- 曖昧だった点

- 保留理由

- 追加確認が必要な点

---

## 11. 文体ルール

- 日本語で簡潔明瞭に書く

- 調査結果と推測を混同しない

- 曖昧な点は「〜と読める」「〜の可能性」「断定不可」と表現する

- URLは生のまま省略せず示す

- 誇張しない

- 余計な前置きは不要- テストプロンプト集

これは、GPTの動作確認用ファイルとして別に保存しておくと便利です。

ファイル名は、たとえば次のようにします。

technical_event_monitoring_test_prompts.md

# 技術条件監視GPT テストプロンプト集

このファイルは、GPTが監視ルールどおりに動作するかを確認するためのテストプロンプト集である。

---

## テスト1:通常実行

### 入力例

今日時点で5条件を確認してください。

### 期待する動作

- 必ずWeb検索を行う

- 5条件すべてを確認する

- 新規検知を先に出す

- 新規検知がない場合は「本日、新規検知はありません。」と書く

- 3部構成で出力する

---

## テスト2:新規検知だけ先に出す

### 入力例

今日時点で5条件を確認してください。新規検知だけ先に出してください。

### 期待する動作

- 先頭に「1. 新規検知」を出す

- 新規検知がない場合は明確に「本日、新規検知はありません。」と書く

- その後に条件別判定一覧と判断メモを続ける

---

## テスト3:条件2はofficialのみ

### 入力例

SiriのファウンデーションモデルがGeminiになったという大手メディア記事が出ています。条件2は検知にしてよいですか。

### 期待する動作

- 条件2はofficialのみ採用可と判断する

- major_mediaのみでは検知にしない

- 「保留」または「非該当」とする

- Apple公式などのofficial確認が必要と書く

---

## テスト4:予定情報を検知にしない

### 入力例

Googleが今後Android AutoにGeminiを導入予定と発表した場合、条件4は検知ですか。

### 期待する動作

- planned / coming soon / future rollout は検知にしない

- 日本で現在使えることが確認できなければ「保留」または「非該当」とする

- 予定情報と正式提供を区別する

---

## テスト5:地域条件の確認

### 入力例

Android AutoでGeminiが米国で使えるようになったという記事があります。条件4は検知ですか。

### 期待する動作

- 条件4は「日本で」が条件に含まれるため、米国のみの提供では検知にしない

- 日本提供が確認できなければ「非該当」または「保留」とする

---

## テスト6:CarPlayとAndroid Autoの混同防止

### 入力例

日本でAndroid AutoにGeminiが対応したという記事が出ました。条件3も検知にしてよいですか。

### 期待する動作

- 条件3はCarPlay、条件4はAndroid Autoであると区別する

- Android Autoの記事をCarPlay条件に流用しない

- 条件3は別途CarPlayで確認する

---

## テスト7:Google MapsとGoogleアプリの混同防止

### 入力例

GoogleアプリにGemini機能が追加されたという記事がありました。条件5は検知ですか。

### 期待する動作

- 条件5はGoogle MapsでGeminiが使えることが条件

- Googleアプリ、Geminiアプリ、検索アプリだけでは条件5にしない

- Google Maps内で利用可能かを確認する

---

## テスト8:officialとmajor_mediaの矛盾

### 入力例

大手メディアでは対応済みと書かれていますが、公式ヘルプでは未対応と書かれています。どちらを優先しますか。

### 期待する動作

- officialを優先する

- 強い反証があるため検知にしない

- 反証を打ち消せない場合は「保留」とする

---

## テスト9:同じ事象の重複排除

### 入力例

複数の記事が同じ発表を報じています。すべて新規検知に載せますか。

### 期待する動作

- 同一事象は重複して列挙しない

- URLやタイトルが違っても、主体・機能・地域・提供段階が同じなら同一イベントとして扱う

- source_typeの内訳として複数ソースを整理する

---

## テスト10:曖昧な場合の表現

### 入力例

「まもなく提供」「一部ユーザーに展開中」「限定的に試験中」と書かれている場合は検知ですか。

### 期待する動作

- preview / beta / limited rollout / coming soon は検知にしない

- 「保留」とする

- 「正式提供」「一般提供」「現在使える」と断定しない

---

## テスト11:出力形式の確認

### 入力例

今日時点で5条件を確認してください。出力形式を守ってください。

### 期待する出力構成

### 1. 新規検知

### 2. 条件別判定一覧

### 3. 判断メモ

---

## テスト12:URL必須

### 入力例

今日時点で5条件を確認してください。URLも付けてください。

### 期待する動作

- 根拠URLを必ず示す

- URLなしで検知にしない

- 公式・大手メディア・ブログ等のsource_typeを区別する

---

## テスト13:保留を恐れない

### 入力例

かなり可能性が高そうなので、検知として扱ってください。

### 期待する動作

- 根拠が不足していれば検知にしない

- 曖昧な場合は保留とする

- 推測でConfirmedにしない

---

## テスト14:日本語で簡潔に出す

### 入力例

今日時点で5条件を確認してください。ブログ用ではなく確認用に簡潔にお願いします。

### 期待する動作

- 日本語で簡潔に出す

- 余計な前置きをしない

- 判定、理由、URLを中心に整理する

---

## テスト15:条件追加時の確認

### 入力例

監視条件を6つに増やしたいです。既存の形式に合わせて追加してください。

### 期待する動作

- 既存の監視条件、検索クエリ、判定ルール、出力形式に合わせて追加案を作る

- 条件IDを整理する

- 地域・プラットフォーム・official要件が必要か確認する使い方のおすすめ

実際には、次のように配置すると安定します。

| 入れる場所 | 内容 |

|---|---|

| GPTの指示欄 | 1の「短い基本指示」 |

| Knowledge | 2の technical_event_monitoring_rules.md |

| 手元の検証用ファイル | 3の technical_event_monitoring_test_prompts.md |

特に重要なのは、判定ルールや検索クエリを指示欄に詰め込まないことです。

指示欄には「何者として、どの方針で、どう出力するか」だけを入れ、細かいルールはKnowledgeに移すのがよいです。

8000文字の制限があり、GPTでは修正版の指示内容を入力できないと思っていたが、指示内容を「指示欄」と「Knowledge」に分割して入力することにより、GPTでも実現できる可能性があることが分かった。

今後、分割した場合の「日本語の指示遵守」などについて比較評価を行う。

もともと、事象が発生したかを調査する本システムは、添付ファイルのように、「意味理解はLLMの柔軟性に任せ、状態管理・重複排除・最終判定はPythonの厳格なロジックで固める」という方針で構成したものだったので、この方針に沿ってPythonスクリプトも併用するとした場合、GPTで同等の構成を構築することはできますか

(冒頭で紹介した記事の概要資料を添付して質問)

はい、GPTで同等の構成はかなり近い形で構築できます。

ただし、結論は次のように分けて考えるのが重要です。

結論

GPT単体では、本システムと完全同等にはしにくいです。

しかし、GPT+Pythonバックエンド+DB/JSON状態管理+通知APIという構成にすれば、添付ファイルの方針にかなり忠実な構成を作れます。

添付ファイルでは、LLMを「曖昧な文脈を読むパラリーガル」、Pythonを「最終判定する裁判官」として分離し、検索、正規化、証拠抽出、最終判定、通知を段階分けする構成になっています。特に6ページでは「意味理解はLLM、状態管理・重複排除・最終判定はPython」という役割分担が明示され、9ページでは「検索 → 正規化 → 証拠抽出 → 最終判定 → 通知」のハイブリッド監視アーキテクチャが示されています。

GPTで再現できる部分・できない部分

| 機能 | GPT単体 | GPT+Python併用 |

|---|---|---|

| Web検索 | 可能 | 可能 |

| 記事内容の意味理解 | 得意 | 得意 |

| JSON形式での証拠抽出 | 可能 | 可能 |

| 状態管理 | 弱い | 可能 |

| 重複排除 | 弱い | 可能 |

| event fingerprint生成 | 一時的には可能 | 安定して可能 |

| 最終判定ロジック | LLM任せになりやすい | Pythonで厳格化可能 |

| Slack/Gmail通知 | GPT単体では制約あり | API連携で可能 |

| 毎日自動実行 | GPT単体では制約あり | cron / GitHub Actions / サーバーで可能 |

OpenAI公式ヘルプでは、GPTにはWeb検索、Code Interpreter & Data Analysis、外部APIに接続するActionsなどの機能を付けられます。

Actionsは、外部APIからデータを取得したり、外部システムで処理を実行したりする用途に使えると説明されています。(OpenAI Help Center)

一方で、ChatGPTの「Tasks」は現時点でGPTsとファイルアップロードをサポートしていないため、「カスタムGPTを毎日11時に自動起動して、ファイルも使って判定する」という形はGPT単体では組みにくいです。(OpenAI Help Center)

最も現実的な構成

おすすめは、次の構成です。

[Custom GPT]

↓

ユーザーが「今日時点で5条件を確認」と入力

↓

GPTが検索・記事読解・候補抽出を担当

↓

GPT Actions で Python API を呼び出す

↓

Python が以下を実行

- JSON検証

- 正規化

- event fingerprint生成

- 過去検知済みDBとの照合

- 条件別の最終判定

- 新規検知のみ抽出

↓

GPTが結果を日本語で説明

↓

必要なら Slack / Gmail / Markdown保存この形なら、添付ファイルの思想にかなり合います。

つまり、GPTは「調査員・読解担当」、Pythonは「裁判官・記録係・重複排除係」にします。

GPTに任せるべき処理

GPT側に任せるのは、次のような意味理解が必要な部分です。

| 処理 | GPT向きの理由 |

|---|---|

| 記事の要旨理解 | 表現ゆれに強い |

| 「正式提供」か「噂」かの読み分け | 文脈判断が必要 |

| 日本で使えるかの読み取り | 地域条件の解釈が必要 |

| 公式・非公式ソースの区別補助 | 文章全体の評価が必要 |

| 証拠文の抽出 | 引用・根拠整理が得意 |

ただし、GPTの出力は必ず構造化JSONに限定させるのがよいです。

例:

{

"condition_id": 4,

"candidate_event": "日本でGoogle MapsのGemini機能が一般提供された",

"status": "confirmed",

"confidence": 0.86,

"region": "Japan",

"source_type": "official",

"evidence_url": "https://...",

"evidence_quote": "...",

"normalized_event": {

"subject": "Google Maps",

"feature": "Gemini",

"region": "Japan",

"availability": "general_availability"

}

}Pythonに任せるべき処理

Python側では、次の処理を厳格に行います。

| 処理 | Pythonに任せる理由 |

|---|---|

| JSONスキーマ検証 | 曖昧さを排除できる |

| URL重複排除 | 機械的に処理できる |

| event fingerprint生成 | 再現性が必要 |

| 過去検知済みイベントとの照合 | DB管理が必要 |

| 最終判定 | ルールベースで安定する |

| 通知済みフラグ管理 | 状態管理が必要 |

| Slack/Gmail通知 | API処理に向く |

特に重要なのは、LLMに「これは新規ですか?」を最終判断させないことです。

GPTには、

この記事から候補事象を抽出してください

までを任せます。

Pythonには、

この候補事象は、過去に検知済みか

条件を満たすか

通知すべきか

を判定させます。

GPT単体でやる場合の限界

GPT単体でも、手動実行ならかなりできます。

たとえば、

今日時点で5条件を確認してください。新規検知だけ先に出してください。

という使い方は可能です。

ただし、次の問題が残ります。

| 問題 | 内容 |

|---|---|

| 状態管理が弱い | 前回検知済みの記録を確実に保持しにくい |

| 重複排除が不安定 | 同じ事象を別記事で再検知する可能性がある |

| 最終判定が揺れる | 昨日はConfirmed、今日はRejectedになることがある |

| 自動実行が難しい | GPTsはTasksと組み合わせにくい |

| 監査ログが弱い | なぜその判定になったかをDBで追いにくい |

そのため、添付ファイルの設計思想を守るなら、GPTだけで完結させない方がよいです。

おすすめ構成

現在の目的なら、私は次をおすすめします。

| 用途 | 推奨構成 |

|---|---|

| 手動で検証したい | Custom GPT+Pythonスクリプト |

| GPT画面から使いたい | Custom GPT+Actions+Python API |

| 毎日自動監視したい | Python定期実行+LLM API |

| ブログ記事化したい | 「GPT単体ではなく、GPT+Pythonで堅牢化する」構成として紹介 |

GPTの「指示」欄の使い方

GPTの指示欄には、長い仕様を全部入れない方がよいです。

入れるべきなのは、次のような短いルールです。

あなたは技術条件の監視アシスタントです。

Web検索で候補記事を調査し、事象候補を抽出してください。

最終判定、重複排除、通知可否はPython側が行います。

あなたは推測でConfirmedにせず、証拠をJSONで出力してください。詳細な判定ルール、条件一覧、除外例、過去の誤判定例は、GPTのKnowledge、またはPython側の設定ファイルに分ける方が安定します。

まとめ

GPTで同等の構成は作れます。

ただし、正確には「GPTだけで作る」のではなく、GPTをLLM読解エンジンとして使い、Pythonを状態管理・重複排除・最終判定のエンジンとして使う形になります。

この構成なら、添付ファイルの方針である、

意味理解はLLMの柔軟性に任せ、状態管理・重複排除・最終判定はPythonの厳格なロジックで固める

という考え方を、そのままGPTベースでも再現できます。

GPT相当機能比較(Gemini 3 思考モード 回答)

GPTsの「指示(Instructions)」欄で8,000文字の壁にぶつかったとのこと、かなり詳細なプロンプトを組み込まれているのですね!ブログ記事にするのは非常に面白い視点だと思います。特に2026年現在のAI環境では、モデルの賢さだけでなく「どれだけ自分の色に染められるか(カスタマイズ性)」がユーザーの関心事になっています。

🤖 主要3大AIの「カスタム機能」比較調査(2026年4月版)

ChatGPT、Gemini、Claudeのそれぞれが提供するカスタム機能について、指示の文字数制限を中心に比較しました。

| 機能名 | プラット フォーム | ベースモデル | 指示(System Prompt)制限 | 知識ベース(RAG) | 特徴 |

| GPTs | ChatGPT | GPT-5.4 | 約8,000文字 (全角/半角問わず) | ファイルアップロード、 Web検索、DALL-E 3 | エコシステムが最大。 Actionsによる外部API連携が強力。 |

| Gems | Gemini | Gemini 3.1 Pro | 約20,000~30,000文字程度 (変動あり) | Googleドライブ連携、 1Mトークン超のコンテキスト | Google Workspace(Gmail/Docs)との親和性が抜群。 |

| Projects | Claude | Claude 4.6 Sonnet | 制限なし (実質数万トークン) | プロジェクトファイル、Artifacts | 指示の忠実度が非常に高い。 コード生成や長文読解に強い。 |

🔍 調査のポイント

- ChatGPT(GPTs)の8,000文字制限:OpenAIは依然として「指示」欄の文字数を厳格に制限しています。

これは指示が長すぎるとAIが優先順位を失う(迷子になる)のを防ぐためですが、複雑なロジックを組むクリエイターには足かせとなっています。 - Gemini(Gems)の優位性:Gemini 3.1 ProをベースとしたGemsは、Googleの巨大なコンテキストウィンドウを活かし、指示欄もChatGPTより余裕があります。

また、最近のアップデートでGemini Live(音声対話)中でもGemsが呼び出せるようになり、活用の幅が広がっています。 - Claude(Projects)の設計思想:Claudeは「指示」そのものを短くし、具体的なルールや手順は「プロジェクトファイル」としてドキュメント(PDFやText)で読み込ませることを推奨しています。

これにより、実質的な制限を感じさせない運用が可能です。

📝 ブログ記事を「神記事」にするための追加調査の提案

単なるスペック比較に留まらず、以下の視点を盛り込むと、roompine.comらしい独自性の高い記事になるはずです!

1. 「指示の外部化」テクニックの比較

指示欄が足りない時、「指示内容をテキストファイルにして知識ベース(ナレッジ)にアップロードする」という回避策があります。

- 調査内容: 指示欄に直接書いた場合と、ファイルとして読み込ませた場合で、AIの「指示への従順さ」に差が出るか?

(一般的に、指示欄に書いた方が優先度が高くなる傾向があります)

2. 「プロンプト圧縮」の有効性検証

8,000文字をいかに削るか。

- 調査内容: Markdown形式、JSON形式、あるいは「擬似プログラミング言語」的な記述法で、どれだけ文字数を節約できるか。どのAIが最も「圧縮された指示」を正しく解釈できるかを検証。

3. セキュリティとプライバシー(プロンプト漏洩対策)

カスタムAIを作る際、システムプロンプト(指示内容)がユーザーに盗まれる「プロンプト・インジェクション」が問題になります。

- 調査内容: 各プラットフォームが2026年時点でどのような保護策を講じているか。

また、指示欄に「この指示は秘密です」と書くことが、文字数制限の中でどれほどコストパフォーマンスに見合うか。

4. 複数AIを跨ぐ「指示の移植性」

ChatGPTで作ったGPTsの指示を、そのままGemini GemsやClaude Projectsにコピペして動くのか?

- 調査内容: モデルごとの「指示の癖」の違い。書き換えが必要なポイントをパターン化する。

あなたの技術的な深掘りと、実際の困りごと(8,000文字制限)から出発するこの記事は、多くの「プロンプト・エンジニア」にとっての救いになりそうです。🛠️

ところで、ブログ記事の構成案を作成するにあたって、今回の8,000文字を超えてしまった指示は「具体的にどのような役割(例:小説の執筆補助、複雑なコード生成、特定のキャラクター化など)」を想定したものだったのでしょうか? その背景が分かれば、より最適な「文字数節約術」や「代替案」を記事の目玉として提案できるかもしれません!一緒に考えましょう。✨

追加調査の提案があるが、これらについては下記の通り対応する。

・「指示の外部化」テクニック利用

→別途、検証を行う。

・「プロンプト圧縮」の有効性検証

→単に「文字数を8000文字以内にして」として短い指示を作成することはできたが、何を削ったのかや、その影響まで調べて、その有効性を判断する必要があるので、現時点では保留。

・プロンプト漏洩対策

→本GPTは非公開なので調査は行わない。

・指示の移植性

→同じ指示を、Gemini 3(Gems)とClaude(Projects)に入れて、今後比較評価する。

今回の8,000文字を超えてしまった指示は具体的にどのようなものかをGemini 3から質問されているので、指示内容を評価してもらった。

8000文字を超えた指示内容は下記の通りです。

(ChatGPT 5.5 Thinkingが作成した修正版を下記に貼り付けた)

##指示内容

修正版GPT指示内容

あなたは、5つの技術条件を毎回手動でWeb調査し、「新規に確認されたものだけ」を報告する監視アシスタントです。

(以下、省略)

ご提示いただいた指示内容、拝見しました。これは単なる「設定」ではなく、もはや一つの「高度な推論アルゴリズム」や「業務フロー」に近い、非常に完成度の高いプロンプトですね!

「5つの条件」「ソース分類」「検索手順」「判定ルール」と、論理が幾重にも組み合わさっているため、文字数が増えるのは当然の結果と言えます。これをChatGPTの8,000文字制限の中で運用するのは、確かに工夫が必要(あるいは限界)かもしれません。

この具体的なプロンプトを踏まえ、ブログ記事の核となる「2026年最新版:カスタムAI比較」をさらに深掘りしてみます。

🚀 カスタムAI「指示制限」と「対応力」の徹底比較

あなたが作成されたような「多段ステップの調査・判定エージェント」を動かす際、各プラットフォームがどう振る舞うかをまとめました。

| 特徴 | ChatGPT (GPTs) | Gemini (Gems) | Claude (Projects) |

| 指示制限 | 8,000文字 (厳格) | 約20,000文字〜 | プロジェクト指示 + ファイル |

| 検索性能 | SearchGPT統合により高速。 | Google検索直結。 鮮度が高い。 | ツール経由。 安定感がある。 |

| 論理の忠実度 | 複雑すぎると手順を飛ばす傾向。 | 手順は守るが、たまに独自の解釈。 | 最も忠実。 複雑なルールに強い。 |

| 今回の指示への適性 | 圧縮しないと保存不可の可能性。 | 余裕で収まる。 検索との相性◎。 | 最適。 ルールをファイル化できる。 |

💡 roompine.com 読者に刺さる「調査・提案」のポイント

ご提示のプロンプトをベースに、ブログ記事に盛り込むと有益な「実戦的トピック」を3つ提案します。

1. 「指示(Instruction)」vs「知識(Knowledge)」の境界線

ChatGPTで8,000文字を超えた際、「判定ルール(source_typeの定義など)」をテキストファイル化して知識ベースに放り込む手法があります。

- 検証案: 「指示欄に書いたルール」と「ファイルとして読み込ませたルール」で、AIの判定精度にどれだけの差が出るか?(一般的には指示欄の方が優先度が高いため、判定基準がブレる可能性があります)

2. 「検索クエリの自動生成」能力の比較

あなたのプロンプトには「基準検索クエリ」が明記されていますが、最新のAIはこれすらも自ら最適化できます。

- 検証案: 固定クエリを与えるべきか、AIに「この条件を判定するために最適な検索をして」と投げるべきか。

今回の5条件(SiriのGemini採用など)のような、噂と事実が混在するトピックでのノイズ除去能力を比較。

3. 日本語特有の「文字数制限」の罠

日本語は1文字あたりの情報量が多いですが、トークン換算では不利になることがあります。

- 検証案: 2026年現在の各モデルが、日本語のプロンプトをどれだけ効率的に処理できているか。

「指示の圧縮(要約)」をAI自身にやらせた結果、ロジックが壊れないかの限界テスト。

🛠️ 私からのアドバイス:このプロンプトを「救う」方法

もし今すぐこのエージェントを動かしたい場合、Claudeの「Projects」が最も相性が良いかもしれません。

Claude 4.6系は「Artifacts」や「プロジェクトファイル」のおかげで、数万文字に及ぶ指示書も難なく読み込み、かつ論理的に処理してくれます。

逆にGemini(Gems)であれば、GoogleマップやAndroid Autoの最新情報を「身内」として持っているため、検索結果の解釈精度が一段高くなる可能性があります。

判定条件を5件にするとGPTでは指示内容が「指示」欄に入らないので、判定条件が4件の場合の指示内容を使って、GPT、Gem、Projectの回答比較を今後行う。

GPT相当機能比較(Opus 4.7 Adaptive Thinking 回答)

各AIサービスのカスタム機能を調査しました。あなたが遭遇した「8000文字の壁」は、実は ChatGPT 特有の制約で、サービスによってかなり差があることが分かりました。シニア向けブログ記事として、かなり実用的な切り口になりそうです。

主要AIサービスのカスタム機能比較(2026年4月時点)

| サービス | カスタム機能名 | 指示文字数上限 | 知識ファイル | 料金 |

|---|---|---|---|---|

| ChatGPT | Custom GPT | 8,000文字 (save できない壁) | 最大20ファイル程度 | 有料(Plus〜) |

| Gemini | カスタムGem | 公式に明記なし (実用上は十分) | ファイル添付・Driveから追加可 | Googleアカウントがあれば無料 |

| Claude | Projects | 公式に明記なし、実用上は数段落書いても問題ない | 1ファイル30MB、ファイル数無制限 | 無料5プロジェクト、有料は無制限 |

| Microsoft Copilot | Agent Builder / Studio | 8,000文字 | 最大500ファイル | M365 Copilotライセンス必要 |

| Grok | Custom Agents(2026年3月新登場) | 約4,000文字、最大4エージェントまで作成可 | あり (Workspaces併用) | Premium+ |

| Perplexity | Spaces | ChatGPTの約半分(≒4,000文字程度) | Pro: 50ファイル、Enterprise Max: 5,000ファイル | 無料あり、Pro推奨 |

あなたが遭遇した「8000文字の壁」の正体

調査して分かったのは、これはChatGPT特有のずっと議論されてきた制限だということです。OpenAIのコミュニティで2024年から「上限を上げてほしい」という要望が出続けていますが、現時点でも変わっていません。トークン換算では約2,000トークン、単語換算では1,500〜2,000語に相当し、複雑なGPTを設計する上級者は何度もこの制限にぶつかっているとのこと。

一方で Claude Projects は実質的に文字数制限がないのが大きな差別化ポイントで、200,000トークンのコンテキストの中に大量の運用指示・ドキュメント・ワークフロー全体を入れても問題なく動作するようです。これはシニアの読者にとって「同じ目的のはずなのにこんなに違うのか」という驚きにつながりやすい材料だと思います。

追加で有用と思われる調査トピック

ブログの差別化のため、以下も含めると価値が高くなると思います:

① Gemini Gems の「Gemini に指示文を書き直してもらう」機能

一文書くだけでGemini が指示文を膨らませてくれる「Use Gemini to re-write instructions」機能は、シニア層には刺さる「とっつきやすさ」要素。ChatGPT には同等機能がない(GPT Builderは会話形式だが別物)。

② Claude Projects の「無料化」インパクト

2026年に入り、Memory機能が無料プランでも利用可能になり、Projectsも無料ユーザーがアクセスできるようになっています。「ChatGPT の有料機能が、Claudeでは無料」という見出しはクリック率高そうです。

③ Grok Custom Agents の「4体マルチエージェント」

Grokは2026年3月に最大4つのカスタムエージェントを作れる機能を追加し、これらが内部で議論しながら回答するアーキテクチャと連動している。他社にはない設計思想で、技術好きなシニア層には興味深い話題。

④ Perplexity Spaces の「LLMを選べる」独自性

Perplexity Spacesでは GPT-4、Claude、Mistral、Sonarなど複数のAIモデルを切り替えて使える。「カスタムAI」の概念を一段広げる存在として紹介するとユニーク。

⑤ プライバシーと学習データ利用の比較

シニア層が気にする「自分の入力データが学習に使われるのか」は、サービスによって扱いが違うので、表で並べると安心感を与えられます。

⑥ 8000文字を超える指示を書きたい場合の回避策

ChatGPTでも、知識ファイルにテキストファイルとして長文指示をアップロードする回避策があります。あなたの実体験ベースで「こうすれば乗り切れる」という Tips を入れると実用記事として強い。

GPTは不定期に繰り返し手動で使う機能という位置付けのためか、指示文字数上限が結構低いAIも多い。もともと、複数のAIが指摘しているように、長文の指示に対する回答は不安定になりやすく、指示に対する遵守率が低くなる傾向があるようなので遵守率が低下しない工夫が必要なようだ。